PyTorch 1.8 チュートリアル : 画像と動画 : 転移学習チュートリアル (翻訳/解説)

翻訳 : (株)クラスキャット セールスインフォメーション

作成日時 : 04/07/2021 (1.8.0)

* 本ページは、PyTorch 1.8 Tutorials の以下のページを翻訳した上で適宜、補足説明したものです:

- Image and Video : Transfer Learning for Computer Vision Tutorial

* サンプルコードの動作確認はしておりますが、必要な場合には適宜、追加改変しています。

* ご自由にリンクを張って頂いてかまいませんが、sales-info@classcat.com までご一報いただけると嬉しいです。

- お住まいの地域に関係なく Web ブラウザからご参加頂けます。事前登録 が必要ですのでご注意ください。

- Windows PC のブラウザからご参加が可能です。スマートデバイスもご利用可能です。

| 人工知能研究開発支援 | 人工知能研修サービス | テレワーク & オンライン授業を支援 |

| PoC(概念実証)を失敗させないための支援 (本支援はセミナーに参加しアンケートに回答した方を対象としています。) | ||

◆ お問合せ : 本件に関するお問い合わせ先は下記までお願いいたします。

| 株式会社クラスキャット セールス・マーケティング本部 セールス・インフォメーション |

| E-Mail:sales-info@classcat.com ; WebSite: https://www.classcat.com/ ; Facebook |

画像と動画 : 転移学習チュートリアル

このチュートリアルでは、転移学習を使用して画像分類のための畳込みニューラルネットワークをどのように訓練するかを学習します。転移学習については cs231n ノート で更に読むことができます。

これらのノートを引用すると、

実際には、非常に少しの人々が畳込みニューラルネットワーク全体を (ランダム初期化で) スクラッチから訓練します、何故ならば十分なサイズのデータセットを持つことは比較的稀 (まれ) だからです。代わりに、非常に巨大なデータセット (e.g. ImageNet, これは 1000 カテゴリを持つ 120 万画像を含みます) 上で ConvNet を事前訓練して、それからその ConvNet を初期化のためか関心があるタスクのための固定された特徴抽出器として利用するのが一般的です。

これらの2つの主要な転移学習シナリオは次のようなものです :

- convnet を再調整する : ランダム初期化の代わりに、imagenet 1000 データセット上で訓練された一つのような、事前訓練されたネットワークでネットワークを初期化します。訓練の残りは通常のようなものです。

- 固定された特徴抽出器としての ConvNet : ここでは、(最後の完全結合層の重みを除く) ネットワークの総てのための重みを凍結します。この最後の完全結合層はランダム重みを持つ新しい一つで置き換えられてこの層だけ訓練されます。

# License: BSD

# Author: Sasank Chilamkurthy

from __future__ import print_function, division

import torch

import torch.nn as nn

import torch.optim as optim

from torch.optim import lr_scheduler

import numpy as np

import torchvision

from torchvision import datasets, models, transforms

import matplotlib.pyplot as plt

import time

import os

import copy

plt.ion() # interactive mode

データをロードする

データをロードするために torchvision と torch.utils.data パッケージを使用します。

今日解いていく問題は アリ (= ants) と ハチ (= bees) を分類するモデルを訓練することです。アリとハチのためにおよそ 120 訓練画像を持ちます。各クラスのために 75 検証画像があります。通常は、スクラッチから訓練される場合、これは (その上で) 一般化するには非常に小さいデータセットです。私達は転移学習を使用していますので、合理的に上手く一般化することができるはずです。

このデータセットは imagenet の非常に小さなサブセットです。

Note: ここ からデータをダウンロードしてそれを現在のディレクトリに展開します。

# Data augmentation and normalization for training

# Just normalization for validation

data_transforms = {

'train': transforms.Compose([

transforms.RandomResizedCrop(224),

transforms.RandomHorizontalFlip(),

transforms.ToTensor(),

transforms.Normalize([0.485, 0.456, 0.406], [0.229, 0.224, 0.225])

]),

'val': transforms.Compose([

transforms.Resize(256),

transforms.CenterCrop(224),

transforms.ToTensor(),

transforms.Normalize([0.485, 0.456, 0.406], [0.229, 0.224, 0.225])

]),

}

data_dir = 'data/hymenoptera_data'

image_datasets = {x: datasets.ImageFolder(os.path.join(data_dir, x),

data_transforms[x])

for x in ['train', 'val']}

dataloaders = {x: torch.utils.data.DataLoader(image_datasets[x], batch_size=4,

shuffle=True, num_workers=4)

for x in ['train', 'val']}

dataset_sizes = {x: len(image_datasets[x]) for x in ['train', 'val']}

class_names = image_datasets['train'].classes

device = torch.device("cuda:0" if torch.cuda.is_available() else "cpu")

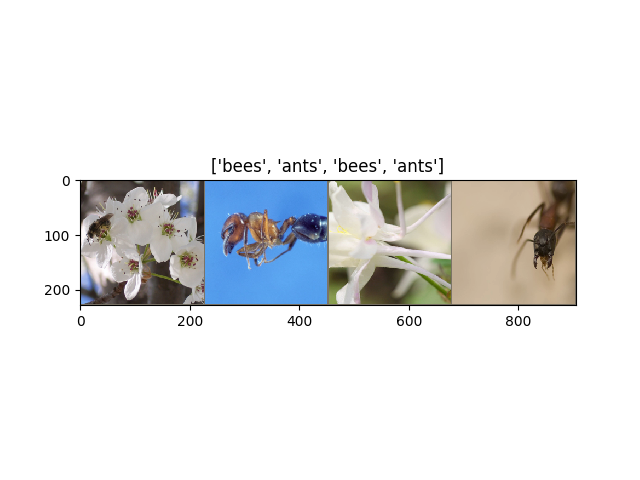

少数の画像を可視化する

データ増強を理解するために少しの訓練画像を可視化しましょう。

def imshow(inp, title=None):

"""Imshow for Tensor."""

inp = inp.numpy().transpose((1, 2, 0))

mean = np.array([0.485, 0.456, 0.406])

std = np.array([0.229, 0.224, 0.225])

inp = std * inp + mean

inp = np.clip(inp, 0, 1)

plt.imshow(inp)

if title is not None:

plt.title(title)

plt.pause(0.001) # pause a bit so that plots are updated

# Get a batch of training data

inputs, classes = next(iter(dataloaders['train']))

# Make a grid from batch

out = torchvision.utils.make_grid(inputs)

imshow(out, title=[class_names[x] for x in classes])

モデルを訓練する

さて、モデルを訓練するための一般的な関数を書きましょう。ここでは、次を示します :

- 学習率をスケジューリングする

- ベスト・モデルをセーブする

以下で、パラメータ・スケジューラは torch.optim.lr_scheduler からの LR スケジューラ・オブジェクトです。

def train_model(model, criterion, optimizer, scheduler, num_epochs=25):

since = time.time()

best_model_wts = copy.deepcopy(model.state_dict())

best_acc = 0.0

for epoch in range(num_epochs):

print('Epoch {}/{}'.format(epoch, num_epochs - 1))

print('-' * 10)

# Each epoch has a training and validation phase

for phase in ['train', 'val']:

if phase == 'train':

model.train() # Set model to training mode

else:

model.eval() # Set model to evaluate mode

running_loss = 0.0

running_corrects = 0

# Iterate over data.

for inputs, labels in dataloaders[phase]:

inputs = inputs.to(device)

labels = labels.to(device)

# zero the parameter gradients

optimizer.zero_grad()

# forward

# track history if only in train

with torch.set_grad_enabled(phase == 'train'):

outputs = model(inputs)

_, preds = torch.max(outputs, 1)

loss = criterion(outputs, labels)

# backward + optimize only if in training phase

if phase == 'train':

loss.backward()

optimizer.step()

# statistics

running_loss += loss.item() * inputs.size(0)

running_corrects += torch.sum(preds == labels.data)

if phase == 'train':

scheduler.step()

epoch_loss = running_loss / dataset_sizes[phase]

epoch_acc = running_corrects.double() / dataset_sizes[phase]

print('{} Loss: {:.4f} Acc: {:.4f}'.format(

phase, epoch_loss, epoch_acc))

# deep copy the model

if phase == 'val' and epoch_acc > best_acc:

best_acc = epoch_acc

best_model_wts = copy.deepcopy(model.state_dict())

print()

time_elapsed = time.time() - since

print('Training complete in {:.0f}m {:.0f}s'.format(

time_elapsed // 60, time_elapsed % 60))

print('Best val Acc: {:4f}'.format(best_acc))

# load best model weights

model.load_state_dict(best_model_wts)

return model

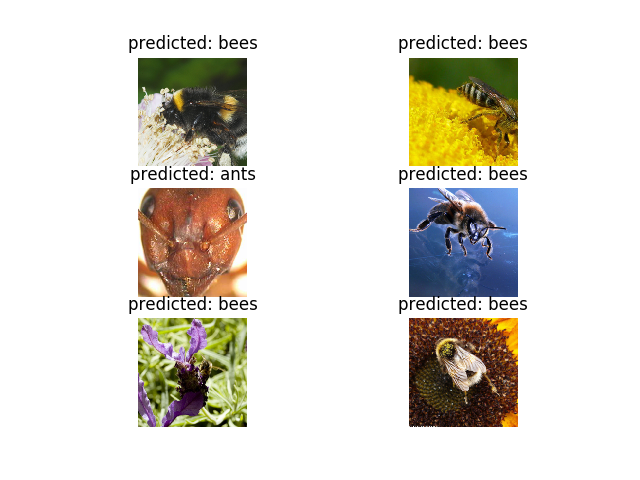

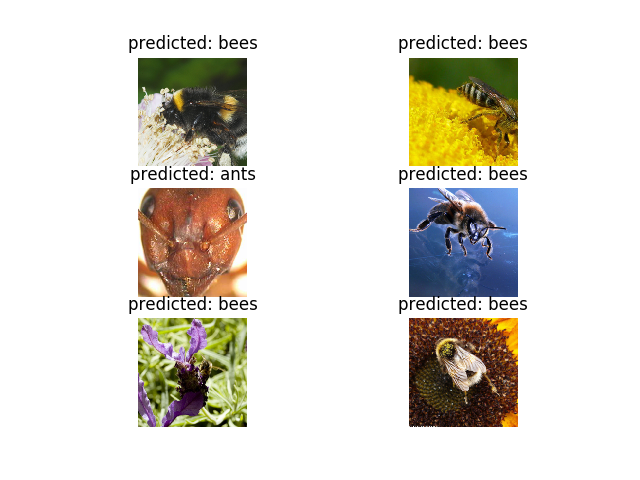

モデル予測を可視化する

少数の画像のための予測を表示するための一般的な関数。

def visualize_model(model, num_images=6):

was_training = model.training

model.eval()

images_so_far = 0

fig = plt.figure()

with torch.no_grad():

for i, (inputs, labels) in enumerate(dataloaders['val']):

inputs = inputs.to(device)

labels = labels.to(device)

outputs = model(inputs)

_, preds = torch.max(outputs, 1)

for j in range(inputs.size()[0]):

images_so_far += 1

ax = plt.subplot(num_images//2, 2, images_so_far)

ax.axis('off')

ax.set_title('predicted: {}'.format(class_names[preds[j]]))

imshow(inputs.cpu().data[j])

if images_so_far == num_images:

model.train(mode=was_training)

return

model.train(mode=was_training)

ConvNet を再調整する

事前訓練されたモデルをロードして最後の完全結合層をリセットします。

model_ft = models.resnet18(pretrained=True)

num_ftrs = model_ft.fc.in_features

# Here the size of each output sample is set to 2.

# Alternatively, it can be generalized to nn.Linear(num_ftrs, len(class_names)).

model_ft.fc = nn.Linear(num_ftrs, 2)

model_ft = model_ft.to(device)

criterion = nn.CrossEntropyLoss()

# Observe that all parameters are being optimized

optimizer_ft = optim.SGD(model_ft.parameters(), lr=0.001, momentum=0.9)

# Decay LR by a factor of 0.1 every 7 epochs

exp_lr_scheduler = lr_scheduler.StepLR(optimizer_ft, step_size=7, gamma=0.1)

訓練と評価

それは CPU 上でおよそ 15-25 分かかるはずです。けれども GPU 上なら、1 分もかかりません。

model_ft = train_model(model_ft, criterion, optimizer_ft, exp_lr_scheduler,

num_epochs=25)

Epoch 0/24 ---------- train Loss: 0.5326 Acc: 0.7090 val Loss: 0.2127 Acc: 0.9346 Epoch 1/24 ---------- train Loss: 0.3823 Acc: 0.8361 val Loss: 0.2400 Acc: 0.9281 Epoch 2/24 ---------- train Loss: 0.5254 Acc: 0.8033 val Loss: 0.6907 Acc: 0.7320 Epoch 3/24 ---------- train Loss: 0.5186 Acc: 0.8033 val Loss: 0.3120 Acc: 0.8954 Epoch 4/24 ---------- train Loss: 0.5303 Acc: 0.8156 val Loss: 0.3634 Acc: 0.8627 Epoch 5/24 ---------- train Loss: 0.6342 Acc: 0.7254 val Loss: 0.2436 Acc: 0.9020 Epoch 6/24 ---------- train Loss: 0.5024 Acc: 0.7828 val Loss: 0.4972 Acc: 0.8235 Epoch 7/24 ---------- train Loss: 0.3610 Acc: 0.8279 val Loss: 0.2187 Acc: 0.9346 Epoch 8/24 ---------- train Loss: 0.2281 Acc: 0.8975 val Loss: 0.2321 Acc: 0.9281 Epoch 9/24 ---------- train Loss: 0.2885 Acc: 0.8730 val Loss: 0.2470 Acc: 0.9150 Epoch 10/24 ---------- train Loss: 0.3342 Acc: 0.8361 val Loss: 0.3471 Acc: 0.8627 Epoch 11/24 ---------- train Loss: 0.2791 Acc: 0.8975 val Loss: 0.2688 Acc: 0.8824 Epoch 12/24 ---------- train Loss: 0.2997 Acc: 0.8730 val Loss: 0.2669 Acc: 0.8824 Epoch 13/24 ---------- train Loss: 0.2387 Acc: 0.9139 val Loss: 0.2528 Acc: 0.9150 Epoch 14/24 ---------- train Loss: 0.2480 Acc: 0.9016 val Loss: 0.2801 Acc: 0.8954 Epoch 15/24 ---------- train Loss: 0.2858 Acc: 0.8730 val Loss: 0.2463 Acc: 0.9150 Epoch 16/24 ---------- train Loss: 0.2538 Acc: 0.9016 val Loss: 0.2622 Acc: 0.9150 Epoch 17/24 ---------- train Loss: 0.3149 Acc: 0.8607 val Loss: 0.2497 Acc: 0.9085 Epoch 18/24 ---------- train Loss: 0.2651 Acc: 0.8852 val Loss: 0.2583 Acc: 0.8954 Epoch 19/24 ---------- train Loss: 0.2004 Acc: 0.9098 val Loss: 0.2446 Acc: 0.9216 Epoch 20/24 ---------- train Loss: 0.3188 Acc: 0.8689 val Loss: 0.2448 Acc: 0.9150 Epoch 21/24 ---------- train Loss: 0.2772 Acc: 0.8525 val Loss: 0.2695 Acc: 0.8889 Epoch 22/24 ---------- train Loss: 0.2494 Acc: 0.8811 val Loss: 0.2901 Acc: 0.8758 Epoch 23/24 ---------- train Loss: 0.2594 Acc: 0.8893 val Loss: 0.2772 Acc: 0.8824 Epoch 24/24 ---------- train Loss: 0.2702 Acc: 0.8893 val Loss: 0.2330 Acc: 0.9216 Training complete in 1m 7s Best val Acc: 0.934641

visualize_model(model_ft)

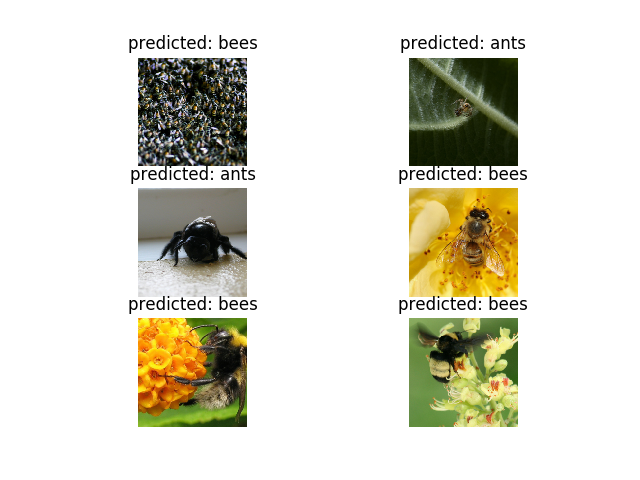

固定された特徴抽出器としての ConvNet

ここでは、最終層を除くネットワーク総てを凍結する必要があります。勾配が backward() で計算されないようにパラメータを凍結するために requires_grad == False を設定する必要があります。

これについては ここ のドキュメントで更に読むことができます。

model_conv = torchvision.models.resnet18(pretrained=True)

for param in model_conv.parameters():

param.requires_grad = False

# Parameters of newly constructed modules have requires_grad=True by default

num_ftrs = model_conv.fc.in_features

model_conv.fc = nn.Linear(num_ftrs, 2)

model_conv = model_conv.to(device)

criterion = nn.CrossEntropyLoss()

# Observe that only parameters of final layer are being optimized as

# opposed to before.

optimizer_conv = optim.SGD(model_conv.fc.parameters(), lr=0.001, momentum=0.9)

# Decay LR by a factor of 0.1 every 7 epochs

exp_lr_scheduler = lr_scheduler.StepLR(optimizer_conv, step_size=7, gamma=0.1)

訓練と評価

これは CPU 上で前のシナリオに比べておよそ半分の時間がかかるでしょう。これはネットワークの殆どに対して勾配が計算される必要がないことが想定されています。けれども、forward は計算される必要があります。

model_conv = train_model(model_conv, criterion, optimizer_conv,

exp_lr_scheduler, num_epochs=25)

Epoch 0/24 ---------- train Loss: 0.5888 Acc: 0.6844 val Loss: 0.2156 Acc: 0.9346 Epoch 1/24 ---------- train Loss: 0.5069 Acc: 0.7541 val Loss: 0.2041 Acc: 0.9542 Epoch 2/24 ---------- train Loss: 0.4989 Acc: 0.7910 val Loss: 0.3322 Acc: 0.8562 Epoch 3/24 ---------- train Loss: 0.5926 Acc: 0.7295 val Loss: 0.3628 Acc: 0.8562 Epoch 4/24 ---------- train Loss: 0.4621 Acc: 0.7951 val Loss: 0.1793 Acc: 0.9412 Epoch 5/24 ---------- train Loss: 0.3790 Acc: 0.8443 val Loss: 0.2022 Acc: 0.9346 Epoch 6/24 ---------- train Loss: 0.4141 Acc: 0.8320 val Loss: 0.1609 Acc: 0.9477 Epoch 7/24 ---------- train Loss: 0.3461 Acc: 0.8197 val Loss: 0.1788 Acc: 0.9412 Epoch 8/24 ---------- train Loss: 0.3670 Acc: 0.8320 val Loss: 0.1653 Acc: 0.9412 Epoch 9/24 ---------- train Loss: 0.3248 Acc: 0.8770 val Loss: 0.1856 Acc: 0.9477 Epoch 10/24 ---------- train Loss: 0.3397 Acc: 0.8648 val Loss: 0.1973 Acc: 0.9412 Epoch 11/24 ---------- train Loss: 0.3358 Acc: 0.8402 val Loss: 0.1877 Acc: 0.9412 Epoch 12/24 ---------- train Loss: 0.4002 Acc: 0.8279 val Loss: 0.1690 Acc: 0.9412 Epoch 13/24 ---------- train Loss: 0.4104 Acc: 0.8156 val Loss: 0.1687 Acc: 0.9542 Epoch 14/24 ---------- train Loss: 0.3459 Acc: 0.8443 val Loss: 0.1830 Acc: 0.9412 Epoch 15/24 ---------- train Loss: 0.2943 Acc: 0.8689 val Loss: 0.1785 Acc: 0.9542 Epoch 16/24 ---------- train Loss: 0.3130 Acc: 0.8607 val Loss: 0.1801 Acc: 0.9412 Epoch 17/24 ---------- train Loss: 0.3356 Acc: 0.8566 val Loss: 0.1692 Acc: 0.9477 Epoch 18/24 ---------- train Loss: 0.2861 Acc: 0.8811 val Loss: 0.1916 Acc: 0.9412 Epoch 19/24 ---------- train Loss: 0.3338 Acc: 0.8443 val Loss: 0.1833 Acc: 0.9412 Epoch 20/24 ---------- train Loss: 0.3391 Acc: 0.8689 val Loss: 0.1689 Acc: 0.9542 Epoch 21/24 ---------- train Loss: 0.3722 Acc: 0.8320 val Loss: 0.1697 Acc: 0.9477 Epoch 22/24 ---------- train Loss: 0.3666 Acc: 0.8402 val Loss: 0.1786 Acc: 0.9412 Epoch 23/24 ---------- train Loss: 0.3582 Acc: 0.8238 val Loss: 0.1830 Acc: 0.9412 Epoch 24/24 ---------- train Loss: 0.3798 Acc: 0.8443 val Loss: 0.1786 Acc: 0.9412 Training complete in 0m 34s Best val Acc: 0.954248

visualize_model(model_conv)

plt.ioff()

plt.show()

Further Learning

転移学習の応用について更に学習したいのであれば、Quantized Transfer Learning for Computer Vision チュートリアル を確認してください。

以上