◆ 〜 2020/12/21

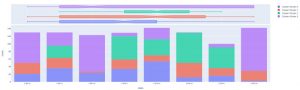

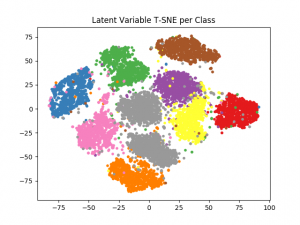

PyCaret 2.2 : チュートリアル : クラスタリング (初級)

PyCaret は機械学習ワークフローを自動化するオープンソースの Python ライブラリで、実験を指数関数的に高速化そして効率化します。本質的には scikit-learn, XGBoost, LightGBM, CatBoost, spaCy, Optuna, Hyperopt, Ray 等のような幾つかの機械学習ライブラリ / フレームワーク周りの Python ラッパーです。

PyCaret 2.2 がリリースされましたので、ドキュメントを幾つか翻訳しています。

今回は初級チュートリアルのクラスタリング編です。ネズミ蛋白質発現のデータセットを題材として扱います。PyCaret の経験は初めてで pycaret.clustering モジュールを使用して回帰から始めることに関心がある読者を想定しています。

[詳細] (12/21/2020)

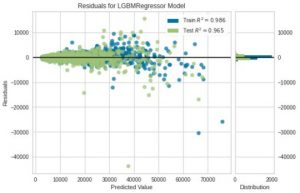

PyCaret 2.2 : チュートリアル : 回帰 (初級)

PyCaret は機械学習ワークフローを自動化するオープンソースの Python ライブラリで、実験を指数関数的に高速化そして効率化します。本質的には scikit-learn, XGBoost, LightGBM, CatBoost, spaCy, Optuna, Hyperopt, Ray 等のような幾つかの機械学習ライブラリ / フレームワーク周りの Python ラッパーです。

PyCaret 2.2 がリリースされましたので、ドキュメントを幾つか翻訳しています。

今回は初級チュートリアルの回帰編です。ダイアモンドの価格データセットを題材として扱います。PyCaret の経験は初めてで pycaret.regression モジュールを使用して回帰から始めることに関心がある読者を想定しています。

[詳細] (12/18/2020)

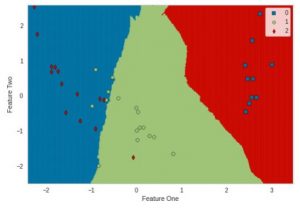

PyCaret 2.2 : チュートリアル : 多クラス分類 (初級)

PyCaret は機械学習ワークフローを自動化するオープンソースの Python ライブラリで、実験を指数関数的に高速化そして効率化します。本質的には scikit-learn, XGBoost, LightGBM, CatBoost, spaCy, Optuna, Hyperopt, Ray 等のような幾つかの機械学習ライブラリ / フレームワーク周りの Python ラッパーです。

PyCaret 2.2 がリリースされましたので、ドキュメントを幾つか翻訳しています。

今回は初級チュートリアルの多クラス分類で伝統的なアイリス・データセットを使用します。PyCaret の経験は初めてで pycaret.classification モジュールを使用して多クラス分類から始めることに関心がある読者を想定しています。

[詳細] (12/17/2020)

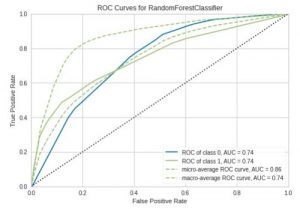

PyCaret 2.2 : チュートリアル : 二値分類 (初級)

PyCaret は機械学習ワークフローを自動化するオープンソースの Python ライブラリで、実験を指数関数的に高速化そして効率化します。本質的には scikit-learn, XGBoost, LightGBM, CatBoost, spaCy, Optuna, Hyperopt, Ray 等のような幾つかの機械学習ライブラリ / フレームワーク周りの Python ラッパーです。

PyCaret 2.2 がリリースされましたので、ドキュメントを幾つか翻訳しています。チュートリアルに入ります。

今回は初級の二値分類です。PyCaret の経験は初めてで pycaret.classification モジュールを使用して二値分類から始めることに関心がある読者を想定しています。

[詳細] (12/15/2020)

PyCaret 2.2 : 概要 (README)

PyCaret は機械学習ワークフローを自動化するオープンソースの Python ライブラリで、実験を指数関数的に高速化そして効率化します。本質的には scikit-learn, XGBoost, LightGBM, CatBoost, spaCy, Optuna, Hyperopt, Ray 等のような幾つかの機械学習ライブラリ / フレームワーク周りの Python ラッパーです。

PyCaret 2.2 がリリースされましたので、ドキュメントを幾つか翻訳していきます。最初は概要 (README) です。

PyCaret の設計と単純性は、シチズン・データサイエンティストのための機械学習タスクを単純化するだけでなく、データサイエンス専門家チーム内での新しいスタートアップで投資コストを減じる手助けを可能にします。

[詳細] (11/25/2020)

fairseq 0.10 : Getting Started

fairseq は PyTorch のエコシステムの一つで、FAIR (Facebook AI Research) が公開した Sequence-to-Sequence ツールキットです。研究者や開発者が翻訳、要約、言語モデリングと他のテキスト生成タスクのためのカスタムモデルを訓練することを可能にし、様々なシークエンス・モデリング論文の参照実装を提供しています。

11月中旬に 0.10 がリリースされましたので、幾つかドキュメントを翻訳しています。

今回の Getting Started では、事前訓練モデルの評価、新しいモデルの訓練、そして半精度浮動小数点 (FP16) や分散訓練を含む、進んだ訓練オプションについて説明されます。

[詳細] (11/24/2020)

fairseq 0.10 : 概要

fairseq は PyTorch のエコシステムの一つで、FAIR (Facebook AI Research) が公開した Sequence-to-Sequence ツールキットです。

研究者や開発者が翻訳、要約、言語モデリングと他のテキスト生成タスクのためのカスタムモデルを訓練することを可能にし、様々なシークエンス・モデリング論文の参照実装を提供しています。

11月中旬に 0.10 がリリースされましたので、幾つかドキュメントを翻訳します。最初は README で参照実装のリストを含みます。

[詳細] (11/23/2020)

PyTorch 1.7.0 リリースノート

PyTorch 1.7 ステーブル版が 10 月末にリリースされましたので、リリースノートのハイライトを翻訳しておきました。前バージョン (1.6) から丁度 3 ヶ月が経過しています。

PyTorch 1.7 では CUDA 11 が公式にサポートされ、NVIDIA A100 GPU とネイティブ TF32 形式のためのサポートが入ってきます。

Windows 上の分散訓練が可能になる他、プロファイリング / 分散訓練のための機能が拡張されています。また、NumPy 互換な高速フーリエ変換や再現性のための torch.set_deterministic もサポートされます。

[詳細] (11/09/2020)

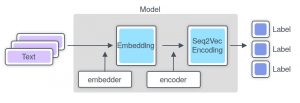

AllenNLP 1.1 : Part1 クイックスタート : Next steps

AllenNLP は the Allen Institute for Artificial Intelligence により開発された PyTorch エコシステムの一つで、NLP (自然言語処理) 深層学習モデルを構築するためのオープンソース・ライブラリです。先月リリースされた 1.1 をベースにドキュメントを幾つか翻訳しています。

AllenNLP は PyTorch の上に構築されて高品質な深層 NLP モデルを容易に構築することを望む研究者、技術者や学生をサポートするために設計されています。現代的な NLP の一般的なコンポーネントとモデルのための高位抽象と API を提供します。NLP 実験の実行と管理を容易にする拡張可能なフレームワークも提供します。

今回は「Part1 クイックスタート」から『Next steps』です。前の 2 章で AllenNLP を使用して動作する NLP モデルを素早く構築しましたが、AllenNLP はより多くのモデル、モジュールと特徴を供給します。これらは広範囲の NLP アプリケーションを開発することを容易にします。

[詳細] (10/10/2020)

AllenNLP 1.1 : Part1 クイックスタート : 訓練と予測

AllenNLP は the Allen Institute for Artificial Intelligence により開発された PyTorch エコシステムの一つで、NLP (自然言語処理) 深層学習モデルを構築するためのオープンソース・ライブラリです。先月リリースされた 1.1 をベースにドキュメントを幾つか翻訳しています。

AllenNLP は PyTorch の上に構築されて高品質な深層 NLP モデルを容易に構築することを望む研究者、技術者や学生をサポートするために設計されています。現代的な NLP の一般的なコンポーネントとモデルのための高位抽象と API を提供します。NLP 実験の実行と管理を容易にする拡張可能なフレームワークも提供します。

今回は「Part1 クイックスタート」から『訓練と予測』です。ガイドのこのセクションでは、貴方のモデルをどのように訓練して新しいデータ上でどのように予測を実行するかを概説します。具体的には、テキスト分類モデルを訓練して新しい入力に対する予測を行なっていきます。

[詳細] (10/09/2020)

AllenNLP 1.1 : Part1 クイックスタート : 貴方の最初のモデル

AllenNLP は the Allen Institute for Artificial Intelligence により開発された PyTorch エコシステムの一つで、NLP (自然言語処理) 深層学習モデルを構築するためのオープンソース・ライブラリです。先月リリースされた 1.1 をベースにドキュメントを幾つか翻訳していきます。

AllenNLP は PyTorch の上に構築されて高品質な深層 NLP モデルを容易に構築することを望む研究者、技術者や学生をサポートするために設計されています。現代的な NLP の一般的なコンポーネントとモデルのための高位抽象と API を提供します。NLP 実験の実行と管理を容易にする拡張可能なフレームワークも提供します。

今回は「Part1 クイックスタート」から『貴方の最初のモデル』です。ガイドのこのセクションでは、AllenNLP が遂行できる最も基本的な事柄から開始します : テキスト分類です。テキスト分類への簡潔な導入説明を与えてから、映画レビューがポジティブかネガティブな感情を表しているかを決定する単純な分類器を実装します。

[詳細] (10/07/2020)

AllenNLP 1.1 : 概要

AllenNLP は the Allen Institute for Artificial Intelligence により開発された PyTorch エコシステムの一つで、NLP (自然言語処理) 深層学習モデルを構築するためのオープンソース・ライブラリです。先月リリースされた 1.1 をベースにドキュメントを幾つか翻訳していきます。

AllenNLP は PyTorch の上に構築されて高品質な深層 NLP モデルを容易に構築することを望む研究者、技術者や学生をサポートするために設計されています。現代的な NLP の一般的なコンポーネントとモデルのための高位抽象と API を提供します。NLP 実験の実行と管理を容易にする拡張可能なフレームワークも提供します。

最初は概要で、AllenNLP の基本概念やドキュメントが提供する内容について説明されます。

[詳細] (10/05/2020)

Flair 0.6 : Tutorial 9: 貴方自身の Flair 埋め込みを訓練する

Flair はベルリン・フンボルト大学で開発された PyTorch のエコシステムの一つで、NLP 最先端技術のための軽量フレームワークです。

先月 0.6 がリリースされましたので幾つかドキュメントを翻訳しています。

今回はチュートリアルから「9: 貴方自身の Flair 埋め込みを訓練する」です。このチュートリアルは貴方自身の Flair 埋め込みをどのように訓練するかを示します、それは Flair を新しい言語やドメインに適用することを望む場合に役立つかもしれません。

[詳細] (10/02/2020)

Flair 0.6 : Tutorial 8: モデル調整

Flair はベルリン・フンボルト大学で開発された PyTorch のエコシステムの一つで、NLP 最先端技術のための軽量フレームワークです。

先月 0.6 がリリースされましたので幾つかドキュメントを翻訳しています。

今回はチュートリアルから「8: モデル調整」です。チュートリアルのこのパートではモデルとハイパーパラメータの正しいセットを選択することによりモデルの品質をどのように改良できるかを調べます。Flair は良く知られたハイパーパラメータ選択ツール hyperopt のためのラッパーを含みます。

[詳細] (10/02/2020)

Flair 0.6 : Tutorial 7: モデルを訓練する

Flair はベルリン・フンボルト大学で開発された PyTorch のエコシステムの一つで、NLP 最先端技術のための軽量フレームワークです。

先月 0.6 がリリースされましたので幾つかドキュメントを翻訳しています。

今回はチュートリアルから「7: モデルを訓練する」です。チュートリアルのこのパートは最先端の単語埋め込みを使用して貴方自身のシークエンス・ラベリングとテキスト分類モデルをどのように訓練するかを示します。

[詳細] (09/30/2020)

Flair 0.6 : Tutorial 6: 訓練データをロードする

Flair はベルリン・フンボルト大学で開発された PyTorch のエコシステムの一つで、NLP 最先端技術のための軽量フレームワークです。

先月 0.6 がリリースされましたので幾つかドキュメントを翻訳しています。

今回はチュートリアルから「6: 訓練データをロードする」です。チュートリアルのこのパートはモデルを訓練するためにコーパスをどのようにロードできるかを示します。

[詳細] (09/29/2020)

Flair 0.6 : Tutorial 5: ドキュメント埋め込み

Flair はベルリン・フンボルト大学で開発された PyTorch のエコシステムの一つで、NLP 最先端技術のための軽量フレームワークです。

先月 0.6 がリリースされましたので幾つかドキュメントを翻訳しています。

今回はチュートリアルから「5: ドキュメント埋め込み」です。ドキュメント埋め込みはそれらがテキスト全体のために一つの埋め込みを与えるという点で単語埋め込みとは異なります。Flair には次の 4 つの主要なドキュメント埋め込みがあります : DocumentPoolEmbeddings, DocumentRNNEmbeddings, TransformerDocumentEmbeddings, SentenceTransformerDocumentEmbeddings。

[詳細] (09/28/2020)

Flair 0.6 : Tutorial 4: 総ての単語埋め込みのリスト

Flair はベルリン・フンボルト大学で開発された PyTorch のエコシステムの一つで、NLP 最先端技術のための軽量フレームワークです。

先月 0.6 がリリースされましたので幾つかドキュメントを翻訳しています。

今回はチュートリアルから「4: 総ての単語埋め込みのリスト」です。これはチュートリアルというよりも、現在 Flair でサポートする総ての埋め込みのリストを示します。Flair, ELMo, BERT と古典的単語埋め込みを結合して利用することも容易です。

[詳細] (09/27/2020)

Flair 0.6 : Tutorial 3: 単語埋め込み

Flair はベルリン・フンボルト大学で開発された PyTorch のエコシステムの一つで、NLP 最先端技術のための軽量フレームワークです。

先月 0.6 がリリースされましたので幾つかドキュメントを翻訳しています。

今回はチュートリアルから「3: 単語埋め込み」です。Flair は様々な方法で単語を埋め込むためのクラスのセットを提供しています。このチュートリアルではそれらがどのように動作するか説明します。古典的単語埋め込み、Flair 埋め込み (contextual string 埋め込み) 更には Stacked 埋め込みについてその使用方法が説明されます。

[詳細] (09/27/2020)

Flair 0.6 : Tutorial 2: テキストにタグ付けする

Flair はベルリン・フンボルト大学で開発された PyTorch のエコシステムの一つで、NLP 最先端技術のための軽量フレームワークです。

先月 0.6 がリリースされましたので幾つかドキュメントを翻訳しています。

今回はチュートリアルから「2: テキストにタグ付けする」です。ここでは貴方のテキストにタグ付けするために事前訓練モデルをどのように利用するかを示します。固有表現認識 (NER) や品詞タギングの他にも、意味フレーム検出やセンチメント分析モデルも用意されています。

[詳細] (09/26/2020)

Flair 0.6 : Tutorial 1: NLP 基底型

Flair はベルリン・フンボルト大学で開発された PyTorch のエコシステムの一つで、NLP 最先端技術のための軽量フレームワークです。

先月 0.6 がリリースされましたので幾つかドキュメントを翻訳しています。

最初はチュートリアルから「1: NLP 基底型」です。ここではライブラリで使用される基底型の幾つかを調べます。

[詳細] (09/25/2020)

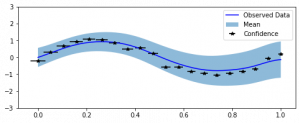

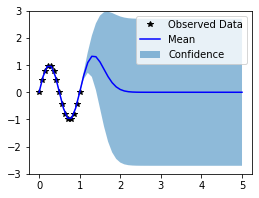

GPyTorch 1.2 Examples : Exact GP (回帰) – 不確かな入力による GP 回帰

GPyTorch は PyTorch のエコシステムの一つで、PyTorch を利用して実装された GPU アクセラレーションを持つ現代的な機械学習のためのガウス過程ライブラリです。PyTorch 1.6 対応の GPyTorch 1.2 がリリースされましたので、幾つかドキュメントを翻訳しています。

この例題では、訓練データの不確かさを扱う一つの方法を実演していきます。

[詳細] (09/05/2020)

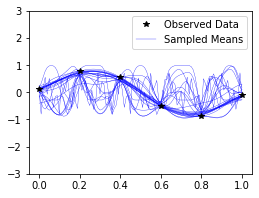

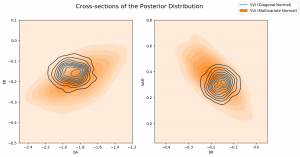

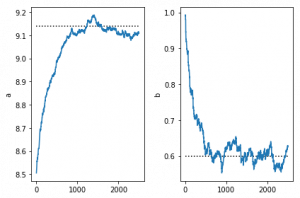

GPyTorch 1.2 Examples : Exact GP (回帰) – Fully Bayesian GP : NUTS でハイパーパラメータをサンプリング

GPyTorch は PyTorch のエコシステムの一つで、PyTorch を利用して実装された GPU アクセラレーションを持つ現代的な機械学習のためのガウス過程ライブラリです。PyTorch 1.6 対応の GPyTorch 1.2 がリリースされましたので、幾つかドキュメントを翻訳しています。

この例題では、GP ハイパーパラメータをサンプリングするために GPyTorch と NUTS をどのように統合するか、そして完全に Bayesian な方法で GP 推論をどのように遂行するかを実演します。

[詳細] (09/05/2020)

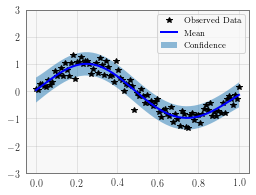

GPyTorch 1.2 Examples : Exact GP (回帰) – スペクトル混合カーネルによる GP 回帰

GPyTorch は PyTorch のエコシステムの一つで、PyTorch を利用して実装された GPU アクセラレーションを持つ現代的な機械学習のためのガウス過程ライブラリです。PyTorch 1.6 対応の GPyTorch 1.2 がリリースされましたので、幾つかドキュメントを翻訳しています。

ガウスノイズモデルによる回帰はガウス過程の規範的な例題です。今回は Exact GP (回帰) の連続したチュートリアルから SpectralMixtureKernel モジュールをどのように使用するかを示します。単純な GP 回帰よりも複雑なカーネルで前の例の上で拡張します。

[詳細] (09/04/2020)

GPyTorch 1.2 Examples : 基本使用方法

GPyTorch は PyTorch のエコシステムの一つで、PyTorch を利用して実装された GPU アクセラレーションを持つ現代的な機械学習のためのガウス過程ライブラリです。PyTorch 1.6 対応の GPyTorch 1.2 がリリースされましたので、幾つかドキュメントを翻訳しています。

今回は基本的な使用方法で、GPyTorch のハイパーパラメータ、パラメータ制約と事前分布の処理、そしてモデルのセーブ/ロードについて説明されます。

[詳細] (09/03/2020)

GPyTorch 1.2 Tutorials : GPyTorch 回帰

GPyTorch は PyTorch のエコシステムの一つで、PyTorch を利用して実装された GPU アクセラレーションを持つ現代的な機械学習のためのガウス過程ライブラリです。PyTorch 1.6 対応の GPyTorch 1.2 がリリースされましたので、幾つかドキュメントを翻訳していきます。

回帰チュートリアルから始めます。スケーラブルで柔軟なモジュール型のガウス過程モデルを容易に作成するために設計されています :

- スケーラビリティ – 数百万のデータポイントでガウス過程を訓練する。

- モジュール設計 – ガウス過程を深層ニューラルネットワークと結合します。

- スピード – GPU アクセラレーションと最先端の推論アルゴリズムを活用します。

[詳細] (09/03/2020)

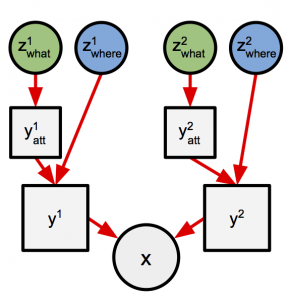

Pyro 1.4 : Examples : 生成モデルによる高速情景理解

Pyro は PyTorch のエコシステムの一つで、PyTorch をバックエンドとして動作する確率的プログラミング言語 (PPL) です。Pyro 1.4 ステーブル版がリリースされていますので、ドキュメントを翻訳しています。

Pyro では SVI (確率的変分推論)を汎用目的推論アルゴリズムとしてサポートするために設計されています。

このチュートリアルでは「Attend, Infer, Repeat: 生成モデルによる高速情景理解」(AIR) で説明されるモデルと推論ストラテジーを実装してそれをマルチ MNIST データセットに適用します。

[詳細] (08/06/2020)

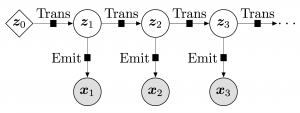

Pyro 1.4 : Examples : 深層マルコフモデル

Pyro は PyTorch のエコシステムの一つで、PyTorch をバックエンドとして動作する確率的プログラミング言語 (PPL) です。Pyro 1.4 ステーブル版がリリースされていますので、ドキュメントを翻訳しています。

Pyro では SVI (確率的変分推論)を汎用目的推論アルゴリズムとしてサポートするために設計されています。

今回は深層マルコフモデルです。シーケンシャルデータのための深層確率モデルを構築していきます。

[詳細] (08/06/2020)

Pyro 1.4 : Examples : ベイジアン回帰 – 推論アルゴリズム (Part 2)

Pyro は PyTorch のエコシステムの一つで、PyTorch をバックエンドとして動作する確率的プログラミング言語 (PPL) です。Pyro 1.4 ステーブル版がリリースされていますので、ドキュメントを翻訳しています。

Pyro では SVI (確率的変分推論)を汎用目的推論アルゴリズムとしてサポートするために設計されています。

今回はベイジアン回帰 Part 2 です。Part 1 では単純なベイジアン線形回帰モデル上で SVI を使用してどのように推論を遂行するかを見ました。Part 2 では同じデータセットを使用して正確な推論テクニックに加えてより表現力のあるガイドを探究します。

[詳細] (08/06/2020)

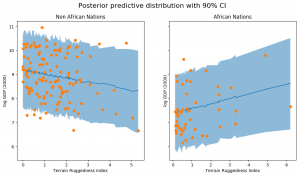

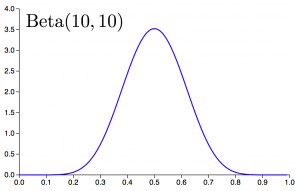

Pyro 1.4 : Examples : ベイジアン回帰 – イントロダクション (Part 1)

Pyro は PyTorch のエコシステムの一つで、PyTorch をバックエンドとして動作する確率的プログラミング言語 (PPL) です。Pyro 1.4 ステーブル版がリリースされていますので、ドキュメントを翻訳しています。

Pyro では SVI (確率的変分推論)を汎用目的推論アルゴリズムとしてサポートするために設計されています。

今回は具体例としてベイジアン回帰を扱います。最初に PyTorch で線形回帰を実装してパラメータのための点推定を学習します。それからベイジアン線形回帰を実装するために Pyro を使用することによりどのように不確かさを推定に組み込むかを見ます。

更に、予測を行なうために Pyro ユティリティ関数をどのように使用するかそして TorchScript を使用してモデルをどのようにサーブするかを学習します。

[詳細] (08/06/2020)

Pyro 1.4 : SVI (2) 条件付き独立性、サブサンプリング及び Amortization

Pyro は PyTorch のエコシステムの一つで、PyTorch をバックエンドとして動作する確率的プログラミング言語 (PPL) です。Pyro 1.4 ステーブル版がリリースされていますので、ドキュメントを翻訳しています。

Pyro では SVI (確率的変分推論)を汎用目的推論アルゴリズムとしてサポートするために注意深く設計されています。Pyro では変分推論を行なうための機構は SVI クラスにカプセル化されています。SVI クラスの詳細な説明に入っています。

今回は SVI を巨大なデータセットにスケールすることを考えます。言語プリミティブ plate と markov の詳細な説明とともに条件付き独立性、サブサンプリング 及び Amortization を扱います。

[詳細] (08/13/2020)

Pyro 1.4 : SVI (1) 確率的変分推論へのイントロダクション

Pyro は PyTorch のエコシステムの一つで、PyTorch をバックエンドとして動作する確率的プログラミング言語 (PPL) です。Pyro 1.4 ステーブル版がリリースされていますので、ドキュメントを翻訳しています。

Pyro では SVI (確率的変分推論)を汎用目的推論アルゴリズムとしてサポートするために注意深く設計されています。Pyro では変分推論を行なうための機構は SVI クラスにカプセル化されています。今回から SVI クラスの詳細な説明に入ります。

[詳細] (08/05/2020)

Pyro 1.4 : Pyro の推論へのイントロダクション

Pyro は PyTorch のエコシステムの一つで、PyTorch をバックエンドとして動作する確率的プログラミング言語 (PPL) です。Pyro 1.4 ステーブル版がリリースされていますので、ドキュメントを翻訳しています。

今回は Pyro の推論へのイントロダクションです。現代的な機械学習の多くは近似推論として位置づけられて Pyro のような確率的プログラミング言語で簡潔に表わされます。

[詳細] (08/03/2020)

Pyro 1.4 : Pyro モデルへのイントロダクション

Pyro は PyTorch のエコシステムの一つで、PyTorch をバックエンドとして動作する確率的プログラミング言語 (PPL) です。Pyro 1.4 ステーブル版がリリースされていますので、ドキュメントを翻訳していきます。

最初は Pyro モデルへのイントロダクションとして、確率的プログラムの基本ユニットである確率関数について説明されます。そしてプリミティブ確率関数と決定論的 Python コードを組み上げて簡単な確率モデルを作成してみます。Pyro でモデルを表わすためにどのように確率関数とプリミティブ分布を使用するかが示されます。

[詳細] (08/02/2020)

PyTorch 1.6.0 リリースノート

PyTorch 1.6 ステーブル版が 7 月 28 日にリリースされましたので、リリースノートのハイライトを翻訳しておきました。前バージョン (1.5) からおよそ 3 ヶ月が経過しています。

PyTorch 1.6 リリースは幾つかの新しい API、パフォーマンス改良とプロファイリングのためのツールそして (分散訓練のための) 分散データ並列 (DDP) とリモートプロシージャコール (RPC) の両者へのメジャーアップデートを含みます。

また PyTorch 1.6 から特徴はステーブル、ベータとプロトタイプに分類されることに注意してください。

[詳細] (07/30/2020)

Pyro 1.3 : Examples : 変分オートエンコーダ

Pyro は PyTorch のエコシステムの一つで、PyTorch をバックエンドとして動作する確率的プログラミング言語 (PPL) です。PyTorch 1.4 ステーブル版のリリースを受けて更新された Pyro 1.3 ステーブル版がリリースされていますので、ドキュメントを翻訳しています。

Pyro では SVI (確率的変分推論)を汎用目的推論アルゴリズムとしてサポートするために設計されています。

今回は変分オートエンコーダを扱います。変分オートエンコーダ (VAE) はほぼ間違いなく深層確率的モデリングを実現するための最も単純なセットアップです。MNIST を題材に Pyro で VAE を実装します。

[詳細] (07/21/2020)

Pyro 1.3 : Pyro のテンソル shape

Pyro は PyTorch のエコシステムの一つで、PyTorch をバックエンドとして動作する確率的プログラミング言語 (PPL) です。PyTorch 1.4 ステーブル版のリリースを受けて更新された Pyro 1.3 ステーブル版がリリースされていますので、ドキュメントを翻訳しています。

Pyro では SVI (確率的変分推論)を汎用目的推論アルゴリズムとしてサポートするために設計されています。

このチュートリアルでは tensor 次元の Pyro の体系を紹介します。PyTorch のブロードキャスト・セマンティクスの知識を前提としています。

[詳細] (07/15/2020)

PyTorch 1.5 Tutorials : PyTorch モデル配備 : TorchScript モデルを C++ でロードする

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

今回は「PyTorch モデル配備」カテゴリーから TorchScript モデルを C++ でロードするためのチュートリアルです。次の 4 ステップで説明されます : (1) PyTorch モデルの Torch Script への変換、(2) Script Module のシリアライズ、(3) Script Module の C++ へのロード、そして (4) Script Module の C++ での実行。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」「PyTorch モデル配備」等のカテゴリーに分かれています。

[詳細] (07/05/2020)

PyTorch 1.5 Tutorials : PyTorch モデル配備 : TorchScript へのイントロダクション

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

今回は「PyTorch モデル配備」カテゴリーから TorchScript へのイントロダクションです。これは C++ のような高パフォーマンス環境内で実行可能な Python モデルの中間表現です。このチュートリアルでは次の項目をカバーします (1) PyTorch モデル・オーサリングの基本、(2) PyTorch モジュールを TorchScript、高パフォーマンス配備ランタイムに変換するためのメソッド群について。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」「PyTorch モデル配備」等のカテゴリーに分かれています。

[詳細] (07/03/2020)

PyTorch 1.5 Tutorials : PyTorch モデル配備 : Flask REST API で PyTorch を配備する

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

今回は「PyTorch モデル配備」カテゴリーから Flask REST API で PyTorch モデルを配備するためのチュートリアルです。Flask を利用してモデルを配備し、モデル推論のための REST API を公開します。画像を検出する、事前訓練された DenseNet 121 モデルを配備します。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」「PyTorch モデル配備」等のカテゴリーに分かれています。

[詳細] (07/02/2020)

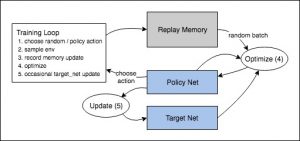

PyTorch 1.5 Tutorials : 強化学習 : 強化学習 (DQN) チュートリアル

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

今回は「強化学習」カテゴリーから DQN (深層 Q-ネットワーク) のチュートリアルです。題材は標準的な OpenAI Gym のカートポールですが、スクリーンを読み取って入力とする CNN を利用したアプローチで実装してみます。最初に再生メモリと DQN アルゴリズムについて簡単に説明された後、Q ネットワークを実装して訓練します。Epsilon-Greedy ポリシーを使用しています。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (05/05/2020)

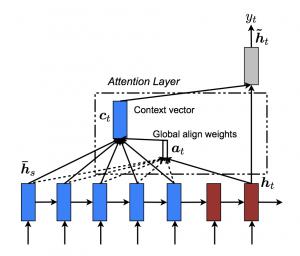

PyTorch 1.5 Tutorials : テキスト : TorchText で言語翻訳

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

今回は「テキスト」カテゴリーから、TorchText による言語翻訳を扱うチュートリアルです。このチュートリアルは、英語とドイツ語の両者のセンテンスを含む良く知られたデータセットからのデータを前処理するためにtorchtext の幾つかの便利なクラスをどのように使用するか、そしてドイツ語センテンスを英語に翻訳できる attention つきの sequence-to-sequence モデルを訓練するためにどのように使用するかを示します。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (07/01/2020)

◆ 〜 2020/06/30

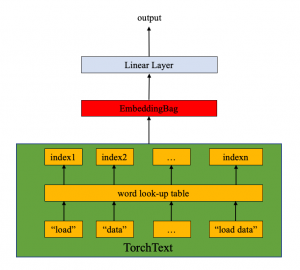

PyTorch 1.5 Tutorials : テキスト : TorchText でテキスト分類

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

今回は「テキスト」カテゴリーから、TorchText によるテキスト分類を扱うチュートリアルです。テキスト分類データセットをどのように使用するか、分類のための教師あり学習アルゴリズムをどのように訓練するか示します。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (06/30/2020)

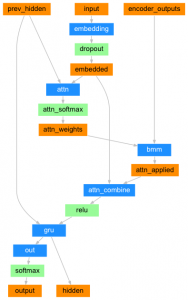

PyTorch 1.5 Tutorials : テキスト : Sequence to Sequence ネットワークと Attention で翻訳

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

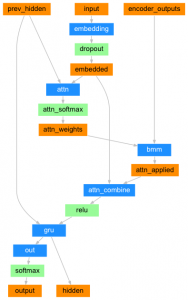

今回は「テキスト」カテゴリーから、アテンションつきの Seq2Seq による機械翻訳を扱うチュートリアルです。ベースとなるモデルは Sequence to Sequence モデルでこれはエンコーダとデコーダの 2 つの RNN から成るモデルです。そしてモデルを改良するためにデコーダにアテンション・メカニズムを組み込み、アテンションの重みの可視化も行ないます。訓練時には “Teacher forcing” の手法も確率的に用います。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (06/28/2020)

PyTorch 1.5 Tutorials : テキスト : 文字レベル RNN で名前を生成する

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

今回は「テキスト」カテゴリーから、名前生成を扱うチュートリアルです。文字レベル RNN で名前生成を遂行する、いわゆる言語モデルによりネットワークから言語を指定して名前をサンプリングします。題材として 18 言語から成る数千の姓名データベースを使用します。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (06/25/2020)

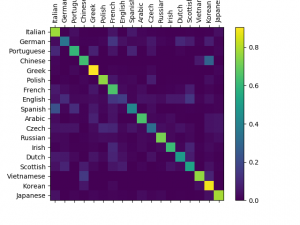

PyTorch 1.5 Tutorials : テキスト : 文字レベル RNN で名前を分類する

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

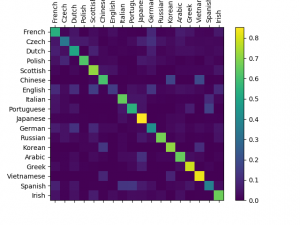

今回は「テキスト」カテゴリーから、文字レベル RNN による名前分類を扱うチュートリアルです。題材は 18 言語から成る数千の姓名データベースで、名前を分類するために基本的な文字レベル RNN を構築して訓練します。予測の評価は混同行列で示されます。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (06/24/2020)

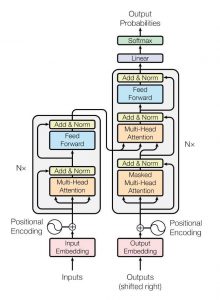

PyTorch 1.5 Tutorials : テキスト : nn.Transformer と TorchText で Sequence-to-Sequence モデリング

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

今回は「テキスト」カテゴリーから、TorchText による Sequence-to-Sequence モデリングを扱うチュートリアルです。nn.Transformer モジュールを使用して sequence-to-sequence モデルをどのように訓練するかについて説明されます。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (06/23/2020)

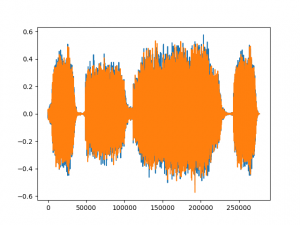

PyTorch 1.5 Tutorials : 音声 : torchaudio チュートリアル

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

今回は「音声」カテゴリーから、torchaudio を扱うチュートリアルです。torchaudio は PyTorch の GPU サポートを活用しながら音声データのロードを容易にして可読にするための多くのツールを提供します。このチュートリアルでは、単純なデータセットから音声データをどのようにロードして前処理するかを見ます。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (06/10/2020)

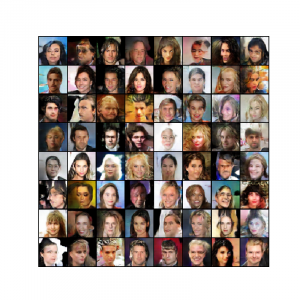

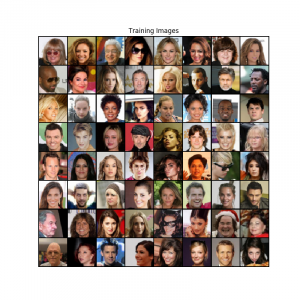

PyTorch 1.5 Tutorials : 画像 : DCGAN チュートリアル

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

今回は「画像」カテゴリーから、DCGAN を扱うチュートリアルです。多くの現実のセレブの写真を題材にして新しいセレブを生成するために GAN (敵対的生成ネットワーク) を訓練します。実装の徹底的な説明とともに、このモデルがどのようにそして何故動作するのかを明らかにします。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (06/09/2020)

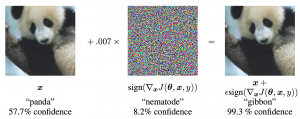

PyTorch 1.5 Tutorials : 画像 : 敵対的サンプルの生成

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

今回は「画像」カテゴリーから、敵対的サンプルの生成を扱うチュートリアルです。機械学習の研究はモデル・パフォーマンスの改良を推し進めていますが、しばしば見落とされる側面はセキュリティと堅牢性です。特にモデルを騙そうとする敵対者の存在です。このチュートリアルでは ML モデルのセキュリティ脆弱性への認識を高め、敵対的機械学習のホットなトピックへの洞察を与えます。ここでは MNIST 分類器を騙すために、高速で最もポピュラーな攻撃メソッドの一つ – 高速勾配 Sign 攻撃 (FGSM) を使用します。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (06/08/2020)

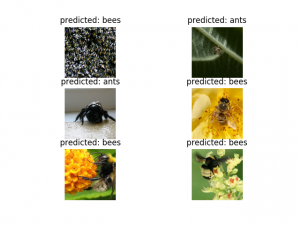

PyTorch 1.5 Tutorials : 画像 : 転移学習チュートリアル

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

今回は「画像」カテゴリーから、転移学習を扱うチュートリアルです。アリとハチのクラス分類を題材に、転移学習を利用してニューラルネットをどのように訓練するかを学習します。一般に十分なサイズのデータセットを持てることは稀ですので、ニューラルネットをスクラッチから訓練するケースは非常に少ないです。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (05/27/2020)

PyTorch 1.5 Tutorials : 画像 : TorchVision 物体検出再調整チュートリアル

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

レシピが終了しましたので、チュートリアル「画像」カテゴリーに移ります。

今回は「画像」カテゴリーから、物体検出の再調整を扱うチュートリアルです。歩行者の検出とセグメンテーションのために事前訓練された Mask R-CNN モデルを再調整していきます。題材はPenn-Fudan データセットで歩行者の 345 インスタンスを伴う 170 画像を含みます。インスタンス・セグメンテーションモデルを訓練するために torchvision の新しい特徴をどのように使用するかを示します。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (05/26/2020)

PyTorch 1.5 レシピ : プロダクション, TorchScript : Flask で配備する

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 では新たにレシピ集がドキュメントに追加されましたので、これも翻訳しています。

今回のレシピは「Flask で配備する」です。このレシピでは以下を学習します : (1) 訓練モデルを web API を通して公開するために Flask コンテナでどのようにラップするか、(2) web リクエストをモデルのために tensor にどのように変換するか、(3) HTTP レスポンスのためにモデルの出力をどのようにパッケージ化するか 。

レシピは「基本」「Captum」「データ・カスタマイゼーション」「解釈可能性」「モデル最適化」等のカテゴリーに分かれています。

[詳細] (05/20/2020)

PyTorch 1.5 レシピ : TorchScript : 配備のための TorchScript

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 では新たにレシピ集がドキュメントに追加されましたので、これも翻訳しています。

今回のレシピは「 配備のための TorchScript」です。このレシピでは TorchScript について以下を学習します : (1) TorchScript とは何か、(2) 訓練モデルを TorchScript 形式でどのようにエクスポートするか、(3) TorchScript モデルを C++ でどのようにロードして推論するか。

レシピは「基本」「Captum」「データ・カスタマイゼーション」「解釈可能性」「モデル最適化」等のカテゴリーに分かれています。

[詳細] (05/19/2020)

PyTorch 1.5 レシピ : 量子化, テキスト, モデル最適化 : 動的量子化

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 では新たにレシピ集がドキュメントに追加されましたので、これも翻訳しています。

今回のレシピは「動的量子化」です。このレシピでは動的量子化とは何か、それはどのような恩恵をもたらすかを説明し、LSTM-スタイルのリカレント・ニューラルネットワーク上の推論を高速化するために動的量子化をどのように利用するかを見ます。これはモデル重みのサイズを削減してモデル実行をスピードアップすることができます。

レシピは「基本」「Captum」「データ・カスタマイゼーション」「解釈可能性」「モデル最適化」等のカテゴリーに分かれています。

[詳細] (05/18/2020)

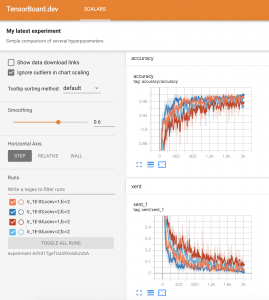

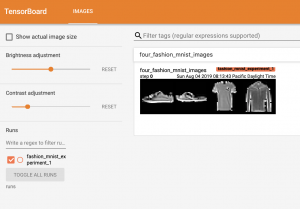

PyTorch 1.5 レシピ : 可視化, TensorBoard : PyTorch でどのように TensorBoard を使用するか

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 では新たにレシピ集がドキュメントに追加されましたので、これも翻訳しています。

今回のレシピは「PyTorch でどのように TensorBoard を使用するか」です。TensorBoard は機械学習実験のための可視化ツールキットです。損失と精度のようなメトリクスを追跡して可視化、モデルグラフの可視化、画像を表示する等を可能にします。

レシピは「基本」「Captum」「データ・カスタマイゼーション」「解釈可能性」「モデル最適化」等のカテゴリーに分かれています。

[詳細] (05/14/2020)

PyTorch 1.5 レシピ : 説明可能性, Captum : Captum を使用したモデル説明可能性

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 では新たにレシピ集がドキュメントに追加されましたので、これも翻訳しています。

今回のレシピは「Captum を使用したモデル説明可能性」です。Captum はモデルがどのように動作するかを明らかにし、データ特徴がモデル予測やニューロン活性にどのように影響を与えるかを理解する助けとなります。Captum を使用すれば統一された方法で Guided GradCam と統合勾配 (= Integrated Gradients) のような広範囲な最先端の特徴 attribution アルゴリズムを適用できます。

レシピは「基本」「Captum」「データ・カスタマイゼーション」「解釈可能性」「モデル最適化」等のカテゴリーに分かれています。

[詳細] (05/15/2020)

PyTorch 1.5 レシピ : データカスタマイゼーション : カスタム PyTorch データローダを開発する

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 では新たにレシピ集がドキュメントに追加されましたので、これも翻訳しています。

今回のレシピは「カスタム PyTorch データローダを開発する」です。機械学習アルゴリズムを開発するために適用される努力の本質的な総量はデータ準備に関係します。PyTorch はデータロードを容易にしてコードを読みやすくするための多くのツールを提供しています。

レシピは「基本」「Captum」「データ・カスタマイゼーション」「解釈可能性」「モデル最適化」等のカテゴリーに分かれています。

[詳細] (05/14/2020)

PyTorch 1.5 レシピ : 基本 : 勾配をゼロで埋める

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 では新たにレシピ集がドキュメントに追加されましたので、これも翻訳しています。

今回は「基本」カテゴリーから「勾配をゼロで埋める」です。ニューラルネットワークを構築するときに勾配をゼロで埋めることは有益です。デフォルトでは勾配は .backward() が呼び出されるときいつでもバッファで累積されるためです。

レシピは「基本」「Captum」「データ・カスタマイゼーション」「解釈可能性」「モデル最適化」等のカテゴリーに分かれています。

[詳細] (05/13/2020)

PyTorch 1.5 レシピ : 基本 : デバイスに渡りモデルをセーブ/ロードする

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 では新たにレシピ集がドキュメントに追加されましたので、これも翻訳しています。

今回は「基本」カテゴリーから「デバイスに渡りモデルをセーブ/ロードする」です。このレシピでは、異なるデバイスに渡りニューラルネットワークをセーブしてロードする事例について説明します。

レシピは「基本」「Captum」「データ・カスタマイゼーション」「解釈可能性」「モデル最適化」等のカテゴリーに分かれています。

[詳細] (05/13/2020)

PyTorch 1.5 レシピ : 基本 : 異なるモデルからのパラメータを使用してモデルをウォームスタートする

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 では新たにレシピ集がドキュメントに追加されましたので、これも翻訳しています。

今回は「基本」カテゴリーから「異なるモデルからのパラメータを使用してモデルをウォームスタートする」です。モデルの一部をロードすることは転移学習や新しい複雑なモデルを訓練するときに必要な一般的なシナリオです。訓練済パラメータの活用は訓練プロセスをウォームスタートする助けとなり、そして貴方のモデルがスクラッチからの訓練よりも高速に収束する助けとなるでしょう。

レシピは「基本」「Captum」「データ・カスタマイゼーション」「解釈可能性」「モデル最適化」等のカテゴリーに分かれています。

[詳細] (05/13/2020)

PyTorch 1.5 レシピ : 基本 : マルチモデルを一つのファイルでセーブ/ロードする

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 では新たにレシピ集がドキュメントに追加されましたので、これも翻訳しています。

今回は「基本」カテゴリーから「マルチモデルを一つのファイルでセーブ/ロードする」です。このレシピでは、PyTorch を使用してマルチモデルを一つのファイルにどのようにセーブするか実演します。GAN、sequence-to-sequence モデルあるいはモデルのアンサンブルのような、マルチ torch.nn.Module から成るモデルをセーブするとき、各モデルの state_dict と対応する optimizer の辞書をセーブしなければなりません。

レシピは「基本」「Captum」「データ・カスタマイゼーション」「解釈可能性」「モデル最適化」等のカテゴリーに分かれています。

[詳細] (05/12/2020)

PyTorch 1.5 レシピ : 基本 : 一般的なチェックポイントをセーブ/ロードする

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 では新たにレシピ集がドキュメントに追加されましたので、これも翻訳しています。

今回は「基本」カテゴリーから「一般的なチェックポイントをセーブ/ロードする」です。推論や訓練を再開するために一般的なチェックポイント・モデルをセーブしてロードすることは有用です。一般的なチェックポイントをセーブするとき、モデルの state_dict だけではなくそれ以上をセーブしなければなりません、optimizer の state_dict もセーブすることも重要です。

レシピは「基本」「Captum」「データ・カスタマイゼーション」「解釈可能性」「モデル最適化」等のカテゴリーに分かれています。

[詳細] (05/12/2020)

PyTorch 1.5 レシピ : 基本 : 推論のためにモデルをセーブ/ロードする

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 では新たにレシピ集がドキュメントに追加されましたので、これも翻訳しています。

今回は「基本」カテゴリーから「推論のためにモデルをセーブ/ロードする」です。PyTorch で推論のためにモデルをセーブしてロードするためには 2 つのアプローチがあります。最初のものは state_dict をセーブ/ロードするもので、そして 2 番目はモデル全体をセーブ/ロードします。

レシピは「基本」「Captum」「データ・カスタマイゼーション」「解釈可能性」「モデル最適化」等のカテゴリーに分かれています。

[詳細] (05/11/2020)

PyTorch 1.5 レシピ : 基本 : PyTorch の state_dict とは何か

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 では新たにレシピ集がドキュメントに追加されましたので、これも翻訳しています。

今回は「基本」カテゴリーから「PyTorch の state_dict とは何か」です。このレシピでは state_dict の利用について説明されます。PyTorch では torch.nn.Module モデルの学習可能パラメータはモデル・パラメータに含まれます。state_dict は各層をそのパラメータ tensor にマップする、単純な Python 辞書オブジェクトです。

レシピは「基本」「Captum」「データ・カスタマイゼーション」「解釈可能性」「モデル最適化」等のカテゴリーに分かれています。

[詳細] (05/08/2020)

PyTorch 1.5 レシピ : 基本 : PyTorch でニューラルネットワークを定義する

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 では新たにレシピ集がドキュメントに追加されましたので、これも翻訳しています。

今回は「基本」カテゴリーから「PyTorch でニューラルネットワークを定義する」です。このレシピでは、MNIST データセット を対象とするニューラルネットワークを定義するために torch.nn を利用します。ニューラルネットワークを作成して訓練することを助けるために PyTorch はエレガントに設計された、torch.nn を含む、モジュールとクラスを提供します。

レシピは「基本」「Captum」「データ・カスタマイゼーション」「解釈可能性」「モデル最適化」等のカテゴリーに分かれています。

[詳細] (05/08/2020)

PyTorch 1.5 レシピ : 基本 : PyTorch でデータをロードする

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 では新たにレシピ集がドキュメントに追加されましたので、これも翻訳していきます。

最初は「基本」カテゴリーから「PyTorch でデータをロードする」です。このレシピでは torchaudio の Yesno データセットを利用します、これはヘブライ語の yes or no の 60 の録音をフィーチャーしています

レシピは「基本」「Captum」「データ・カスタマイゼーション」「解釈可能性」「モデル最適化」等のカテゴリーに分かれています。

[詳細] (05/08/2020)

PyTorch 1.5 : PyTorch の学習 : TensorBoard でモデル、データと訓練を可視化する

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

今回は「PyTorch の学習」から TensorBoard のチュートリアルです。PyTorch は TensorBoard と統合されています、これはニューラルネット訓練実行の結果を可視化するために設計されたツールです。このチュートリアルでは Fashion-MNIST データセットを利用してその機能の幾つかを示します。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (05/07/2020)

PyTorch 1.5 : PyTorch の学習 : torch.nn とは実際には何でしょう?

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

今回は「PyTorch の学習」から torch.nn の詳細なチュートリアルです。ニューラルネットを作成して訓練するため PyTorch はエレガントに設計されたモジュールとクラス torch.nn , torch.optim , Dataset と DataLoader を提供します。理解を深めるため、最初はこれらからのどのような機能も利用することなく MNIST データセット上の基本的なニューラルネットを訓練します ; それから torch.nn, torch.optim, Dataset と DataLoader から一つずつ追加しながらコードをリファクタリングしていくとともに、各ピースが何をしているか、どのように動作するかを正確に示します。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (05/06/2020)

PyTorch 1.5 : PyTorch の学習 : サンプルによる PyTorch の学習

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳しています。

今回は「PyTorch の学習」から、サンプルによる PyTorch の学習のチュートリアルの翻訳です。自己充足的なサンプルを通して PyTorch の基礎的な概念を紹介します。PyTorch Tensor と Autograd の基本事項から始めて、nn / optim パッケージを利用してニューラルネットワークを実装していきます。TensorFlow の静的計算グラフとの比較についても違いを明瞭化する実装例とともに説明されています。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (04/29/2020)

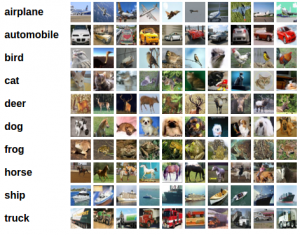

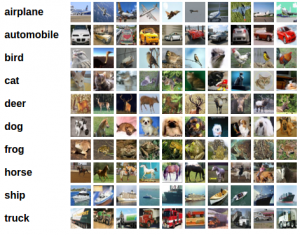

PyTorch 1.5 : PyTorch の学習 : 分類器を訓練する – CIFAR-10

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳していきます。

今回は「PyTorch の学習」から、シングル GPU 上での CIFAR-10 の分類器訓練を扱うチュートリアルです。具体的には次のステップを実行します : (1) CIFAR10 訓練/テスト・データセットをロードして正規化、(2) 畳込みニューラルネットワークを定義、(3 ) 損失関数を定義、(4) 訓練データ上でネットワークを訓練、そして (5) テストデータでネットワークを評価します。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (04/28/2020)

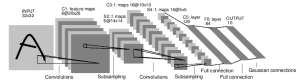

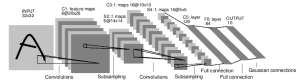

PyTorch 1.5 : PyTorch の学習 : ニューラルネットワーク

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳していきます。

今回は「PyTorch の学習」から、ニューラルネットワークを扱うチュートリアルです。標準的な LeNet を題材にした PyTorch ニューラルネットの概要です。PyTorch におけるニューラルネットの定義・損失関数・逆伝播・重みの更新について説明されます。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (04/27/2020)

PyTorch 1.5 : PyTorch の学習 : Autograd: 自動微分

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳していきます。

今回は「PyTorch の学習」から、Autograd: 自動微分を扱うチュートリアルです。PyTorch で総てのニューラルネットワークの中核をなす autograd パッケージを扱います。autograd は tensor 上の総ての演算に対して自動微分を提供します。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (04/27/2020)

PyTorch 1.5 : PyTorch の学習 : PyTorch とは何か?

PyTorch は TensorFlow とともにポピュラーな深層学習フレームワークです。PyTorch 1.5 が 4 月にリリースされてドキュメントも再構成されていますので再翻訳していきます。

最初は「PyTorch の学習」から、PyTorch の基本である テンソル、演算、Numpy ブリッジ、CUDA テンソルについての簡単な説明が提供されます。

チュートリアルは「PyTorch の学習」「画像/ビデオ」「音声」「テキスト」「強化学習」等のカテゴリーに分かれています。

[詳細] (04/27/2020)

PyTorch 1.5.0 リリースノート

PyTorch 1.5 ステーブル版が 4 月 22 日にリリースされましたので、リリースノートのハイライトを翻訳しておきました。前バージョン (1.4) からおよそ 3 ヶ月が経過しています。

ハイライトのステーブルな機能は、C++ フロントエンド API と分散 RPC フレームワーク API です。C++ フロントエンド API は今では Python と同等のレベルで利用可能になり、ユーザはモデルを Python API から C++ API に容易に変換できます。

試験的な機能としては、コンピュータビジョン・モデルのための channels last メモリ形式のサポート、カスタム C++ クラスを TorchScript と Python に同時にバインドするための新しい API、更には新しい高位 autograd API が追加されています。

Python 2 はもはやサポートされないことに注意してください。

[詳細] (01/18/2020)

◆ 〜 2020/01/24

PyTorch 1.4 Tutorials : PyTorch モデル配備 : (オプション) PyTorch から ONNX へモデルをエクスポートして ONNX ランタイムを使用してそれを実行する

PyTorch は TensorFlow とともに多く利用されている深層学習フレームワークです。1.4 がリリースされましたので、1.4 ドキュメントをベースに翻訳を進めます。

PyTorch は TensorFlow とともに多く利用されている深層学習フレームワークです。1.4 がリリースされましたので、1.4 ドキュメントをベースに翻訳を進めます。

今回は「PyTorch モデル配備」カテゴリーから ONNX へのエクスポートと、ONNX ランタイムで実行するためのチュートリアルです。題材とするモデルは超解像 (= super-resolution) モデルです。これは画像、動画の解像度を増大させる方法で画像処理や動画編集で広く使用されます。

チュートリアルは「Getting Started」「画像」「音声」「テキスト」「強化学習」「モデル配備」「分散訓練」等々のカテゴリーに分かれています。

[詳細] (01/21/2020)

PyTorch 1.4 Tutorials : PyTorch モデル配備 : TorchScript モデルを C++ でロードする

PyTorch は TensorFlow とともに多く利用されている深層学習フレームワークです。1.4 がリリースされましたので、1.4 ドキュメントをベースに翻訳を進めます。

今回は「PyTorch モデル配備」カテゴリーから TorchScript モデルを C++ でロードするためのチュートリアルです。次の 4 ステップで説明されます : (1) PyTorch モデルの Torch Script への変換、(2) Script Module のシリアライズ、(3) Script Module の C++ へのロード、そして (4) Script Module の C++ での実行。

チュートリアルは「Getting Started」「画像」「音声」「テキスト」「強化学習」「モデル配備」「分散訓練」等々のカテゴリーに分かれています。

[詳細] (01/24/2020)

PyTorch 1.4.0 リリースノート

PyTorch 1.4.0 ステーブル版がリリースされました。リリースノートのハイライトと新しい機能のセクションを翻訳しておきました。

ハイライトとして最初に、(1.3 リリースの PyTorch モバイルの試験的リリースに追随して) PyTorch 1.4 ではきめ細かいレベルでビルドスクリプトをカスタマイズする機能を含む追加のモバイル・サポートが導入されます。

その他には分散モデル並列訓練、Java バインディングそして Pruning にフォーカスが当てられています。分散モデル並列訓練は分散 RPC フレームワークの導入です。分散モデル並列訓練と Java バインディングは試験的な導入になります。

新しい特徴で興味深いのは、torch.optim の学習率スケジューラの chaining (連鎖) が可能になったことです。

[詳細] (01/18/2020)

PyTorch 1.3 Tutorials : 名前付き tensor (試験的) : 名前付き tensor へのイントロダクション

PyTorch は TensorFlow とともに多く利用されている深層学習フレームワークです。1.3 では機能が大幅に追加されてドキュメントも追加・修正が入っていますので、順次再翻訳しています。

今回は「名前付き tensor」のチュートリアルです。名前付き (= named) tensor は PyTorch 1.3 で試験的に導入された機能で、明示的な名前を tensor 次元と関連付けることを可能にすることにより tensor を利用しやすくすることを目標にしています。

チュートリアルは「Getting Started」「画像」「音声」「テキスト」「強化学習」「分散訓練」等々のカテゴリーに分かれています。

[詳細] (01/16/2020)

◆ 〜 2019/12/20

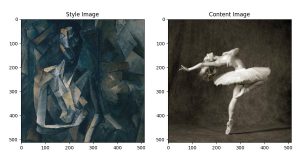

PyTorch 1.3 Tutorials : 画像 : PyTorch を利用した画風変換

PyTorch は TensorFlow とともに多く利用されている深層学習フレームワークです。1.3 では機能が大幅に追加されてドキュメントも追加・修正が入っていますので、順次再翻訳しています。

PyTorch は TensorFlow とともに多く利用されている深層学習フレームワークです。1.3 では機能が大幅に追加されてドキュメントも追加・修正が入っていますので、順次再翻訳しています。

今回は「画像」カテゴリーから、画風変換 (Neural Style Transfer) を扱うチュートリアルです。画風変換アルゴリズムを PyTorch でどのように実装するか説明します。画風変換は画像を取りそれを新しい芸術的なスタイルで再生成することを可能にします。

チュートリアルは「Getting Started」「画像」「音声」「テキスト」「強化学習」「分散訓練」等々のカテゴリーに分かれています。

[詳細] (12/20/2019)

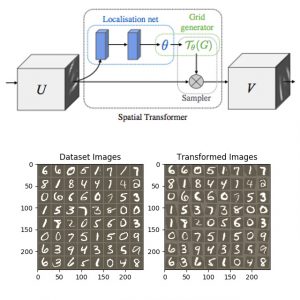

PyTorch 1.3 Tutorials : 画像 : Spatial Transformer ネットワーク

PyTorch は TensorFlow とともに多く利用されている深層学習フレームワークです。11 月に PyTorch 1.3.1 がリリースされています。1.3 では機能が大幅に追加されてドキュメントも追加・修正が入っていますので、順次再翻訳していきます。

PyTorch は TensorFlow とともに多く利用されている深層学習フレームワークです。11 月に PyTorch 1.3.1 がリリースされています。1.3 では機能が大幅に追加されてドキュメントも追加・修正が入っていますので、順次再翻訳していきます。

今回は「画像」カテゴリーから、Spatial Transformer ネットワーク (STN) を扱うチュートリアルです。この視覚アテンション・メカニズムを使用してネットワークを増強することができます。MNIST データセットを題材に STN で増強した標準的な ConvNet で実験してみます。

STN はニューラルネットがモデルの幾何学的不変性を強めるために入力画像上でどのように空間変換を遂行するかを学習することを可能にします。これは有用なメカニズムになりえます、何故ならば ConvNet は回転とスケールと更に一般的なアフィン変換に対して不変ではないからです。

チュートリアルは「Getting Started」「画像」「音声」「テキスト」「強化学習」「分散訓練」等々のカテゴリーに分かれています。

[詳細] (12/20/2019)

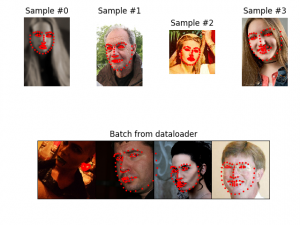

PyTorch 1.3 : Getting Started : カスタムデータセット、データローダを書いて変換する

PyTorch は TensorFlow とともに多く利用されている深層学習フレームワークです。11 月に PyTorch 1.3.1 がリリースされています。1.3 では機能が大幅に追加されてドキュメントも追加・修正が入っていますので、順次再翻訳していきます。

PyTorch は TensorFlow とともに多く利用されている深層学習フレームワークです。11 月に PyTorch 1.3.1 がリリースされています。1.3 では機能が大幅に追加されてドキュメントも追加・修正が入っていますので、順次再翻訳していきます。

今回は Getting Started から、データローダを扱うチュートリアルです。題材は顔姿勢のデータセットで、各画像には 68 の異なる目印ポイントがアノテーションとして提供されています。そして torch.utils.data パッケージの Dataset と DataLoader、更には Transform をどのように利用してデータのローディングを実装するかを見ていきます。

チュートリアルは「Getting Started」「画像」「音声」「テキスト」「強化学習」「分散訓練」等々のカテゴリーに分かれています。

[詳細] (12/14/2019)

PyTorch 1.3 : Getting Started : データ並列 (オプション)

PyTorch は TensorFlow とともに多く利用されている深層学習フレームワークです。11 月に PyTorch 1.3.1 がリリースされています。1.3 では機能が大幅に追加されてドキュメントも追加・修正が入っていますので、順次再翻訳していきます。

今回は Getting Started から、データ並列を扱うチュートリアルです。このチュートリアルでは DataParallel を使用してマルチ GPU をどのように使用するかを学習します。

チュートリアルは「Getting Started」「画像」「音声」「テキスト」「強化学習」「分散訓練」等々のカテゴリーに分かれています。

[詳細] (12/12/2019)

◆ 〜 2019/07/24

PyTorch 1.1 : Tutorials :- テキスト : チャットボット

PyTorch 1.1 リリースのチュートリアルの再翻訳を進めています。

PyTorch 1.1 リリースのチュートリアルの再翻訳を進めています。

今回は「テキスト」カテゴリーからチャットボットのチュートリアルです。対話モデルは人工知能研究のホットなトピックです。チャットボットはカスタマーサービスやオンライン・ヘルプデスクを含む様々なアプリケーションで見い出すことができます。このチュートリアルでは、リカレント sequence-to-sequence モデルの興味深いユースケースを探究します。映画スクリプトを使用して単純なチャットボットを訓練します。

PyTorch は TensorFlow とともに多く利用されている深層学習フレームワークです。5 月に PyTorch 1.1 がリリースされ 1.0 のドキュメントから追加や修正が入っていますので、順次再翻訳しています。PyTorch 1.x では JIT コンパイラ等のプロダクション・サポートのための機能が追加され、大規模スケールでモデルを効率的に実行することが可能になりました。

[詳細] (07/24/2019)

PyTorch 1.1 : 画像 : ONNX を使用して PyTorch から Caffe2 とモバイルにモデルを移す

PyTorch 1.1 リリースのチュートリアルの再翻訳を進めています。

PyTorch 1.1 リリースのチュートリアルの再翻訳を進めています。

今回は「画像」カテゴリーから ONNX を使用して PyTorch から Caffe2、更にモバイル環境にモデルを移行するチュートリアルです。

このチュートリアルでは、超解像ネットワーク (Super-Resolution) を題材にして、PyTorch で定義された超解像モデルをどのように ONNX フォーマットに変換するか、そしてそれをどのように Caffe2 にロードするかについて説明します。更にモバイルデバイス (Android) へのロード・実行方法も解説します。

PyTorch は TensorFlow とともに多く利用されている深層学習フレームワークです。5 月に PyTorch 1.1 がリリースされ 1.0 のドキュメントから追加や修正が入っていますので、順次再翻訳しています。PyTorch 1.x では JIT コンパイラ等のプロダクション・サポートのための機能が追加され、大規模スケールでモデルを効率的に実行することが可能になりました。

[詳細] (07/12/2019)

◆ 〜 2019/06/29

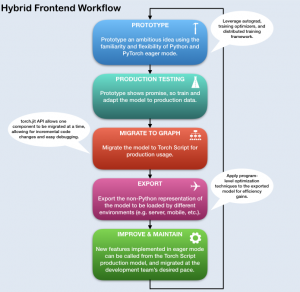

PyTorch 1.1 : Getting Started : Seq2Seq モデルをハイブリッド・フロントエンドで配備する

PyTorch は TensorFlow とともに多く利用されている深層学習フレームワークです。5 月に PyTorch 1.1 がリリースされ 1.0 のドキュメントから追加や修正が入っていますので、順次再翻訳しています。

PyTorch は TensorFlow とともに多く利用されている深層学習フレームワークです。5 月に PyTorch 1.1 がリリースされ 1.0 のドキュメントから追加や修正が入っていますので、順次再翻訳しています。

今回は Getting Started の中から、Seq2Seq モデルのハイブリッド・フロントエンドによる配備を扱います。このチュートリアルではチャットボット・モデルを題材に PyTorch のハイブリッド・フロントエンドを利用して Seq2Seq モデルを Torch Script に移行する過程をウォークスルーします。

PyTorch 1.x では JIT コンパイラ等のプロダクション・サポートのための機能が追加され、大規模スケールでモデルを効率的に実行することが可能になりました。

[詳細] (06/29/2019)

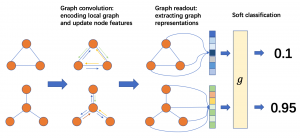

PyTorch : Deep Graph Library Tutorials : DGL でバッチ処理によるグラフ分類

DGL (Deep Graph Library) はグラフ上の深層学習のための Python パッケージです。PyTorch 上に構築されていて PyTorch のエコシステムの一つになっています。

DGL (Deep Graph Library) はグラフ上の深層学習のための Python パッケージです。PyTorch 上に構築されていて PyTorch のエコシステムの一つになっています。

幾つかチュートリアルが用意されていますので、順次翻訳しています。今回のチュートリアルはグラフ分類問題を扱います。グラフ分類は多くの分野で重要なタスクです – バイオインフォマティクス、ケモインフォマティクス、ソーシャルネットワーク分析、 アーバンコンピューティングそしてサイバー・セキュリティ等。これらの問題にグラフニューラルネットを適用することは最近ではポピュラーなアプローチです。このチュートリアルでは以下が示されます : (1) 可変なサイズと shape の多重グラフを DGL でバッチ処理する、(2) 単純なグラフ分類タスクのためにグラフニューラルネットワークを訓練する。

DGL の利用でグラフニューラルネットの実装が単純化され、数十億のノード/エッジを持つグラフ上の半教師あり学習、グラフ上の生成モデル、TreeLSTM のような樹木モデル etc. が実装可能です。GCN (グラフ畳み込みネットワーク) モデルの実装も紹介されます。

[詳細] (06/05/2019)

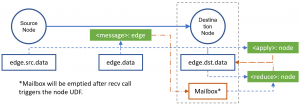

PyTorch : Deep Graph Library Tutorials : DGL メッセージパッシングによるページランク

DGL (Deep Graph Library) はグラフ上の深層学習のための Python パッケージです。PyTorch 上に構築されていて PyTorch のエコシステムの一つになっています。

DGL (Deep Graph Library) はグラフ上の深層学習のための Python パッケージです。PyTorch 上に構築されていて PyTorch のエコシステムの一つになっています。

幾つかチュートリアルが用意されていますので、順次翻訳しています。今回のチュートリアルは DGL によるページランク・アルゴリズムの実装です。DGL メッセージパッシング API を使用して小さいグラフ上のページランクを実装します。

DGL の利用でグラフニューラルネットの実装が単純化され、数十億のノード/エッジを持つグラフ上の半教師あり学習、グラフ上の生成モデル、TreeLSTM のような樹木モデル etc. が実装可能です。GCN (グラフ畳み込みネットワーク) モデルの実装も紹介されます。

[詳細] (06/04/2019)

PyTorch : Deep Graph Library Tutorials : DGL 基本

DGL (Deep Graph Library) はグラフ上の深層学習専用の Python パッケージです。PyTorch 上に構築されていて PyTorch のエコシステムの一つになっています。

DGL (Deep Graph Library) はグラフ上の深層学習専用の Python パッケージです。PyTorch 上に構築されていて PyTorch のエコシステムの一つになっています。

グラフニューラルネットの実装が単純化され、数十億のノード/エッジを持つグラフ上の半教師あり学習、グラフ上の生成モデル、TreeLSTM のような樹木モデル etc. が実装可能です。GCN (グラフ畳み込みネットワーク) モデルの実装も紹介されます。

幾つかチュートリアルが用意されていますので、順次翻訳しています。今回のチュートリアルは DGL の最も基本的な事項を扱います。(1) グラフを作成し、そして (2) ノードとエッジ表現を読み書きします。

[詳細] (06/03/2019)

PyTorch : Deep Graph Library Tutorials : ひとめでわかる DGL

DGL (Deep Graph Library) はグラフ上の深層学習専用の Python パッケージです。PyTorch 上に構築されていて PyTorch のエコシステムの一つになっています。

DGL (Deep Graph Library) はグラフ上の深層学習専用の Python パッケージです。PyTorch 上に構築されていて PyTorch のエコシステムの一つになっています。

グラフニューラルネットワークの実装が単純化され、数十億のノード/エッジを持つグラフ上の半教師あり学習、グラフ上の生成モデル、TreeLSTM のような樹木モデル etc. が実装可能です。GCN (グラフ畳み込みネットワーク) モデルの実装は最初のチュートリアルで紹介されます。

幾つかチュートリアルが用意されていますので、順次翻訳していきます。最初のチュートリアルの目標は、(1) DGL がどのようにグラフ上の計算を可能にするか高位レベルで理解する、そして (2) グラフのノードを分類するために DGL で単純なグラフニューラルネットワークを作成して訓練することです。良く知られたコミュニティ分割問題「Zachary の空手クラブ」を題材としています。

[詳細] (06/02/2019)

◆ 〜 2019/01/13

PyTorch & TensorFlow : ClassCat® TF / ONNX Hub : セマンティック・セグメンテーション

「ClassCat® TF / ONNX Hub」はクラスキャットが提供する実用性の高い機械学習モデルのレポジトリです。

「ClassCat® TF / ONNX Hub」はクラスキャットが提供する実用性の高い機械学習モデルのレポジトリです。

今回は超音波画像や電子顕微鏡写真を題材にセマンティック・セグメンテーション・モデルを紹介致します。

「ClassCat TF / ONNX Hub」で提供されるモデルについてはクラスキャットが検証の上で仕様を公開致しますので、ユーザ企業は希望するモデルを自由に選択することが可能です。またユーザ企業の保持するデータセットによる再調整も含めて、配備・実運用するために必要なトータルサポートを提供致します。

[詳細] (01/13/2019)

PyTorch & TensorFlow : ClassCat® TF / ONNX Hub : Detectron 互換 物体検出モデル

「ClassCat® TF / ONNX Hub」はクラスキャットが提供する実用性の高い機械学習モデルのレポジトリです。

「ClassCat® TF / ONNX Hub」はクラスキャットが提供する実用性の高い機械学習モデルのレポジトリです。

今回は物体検出モデルの代表例である、Mask R-CNN をサポートする Detectron 互換モデルを紹介致します。

「ClassCat TF / ONNX Hub」で提供されるモデルについてはクラスキャットが検証の上で仕様を公開致しますので、ユーザ企業は希望するモデルを自由に選択することが可能です。またユーザ企業の保持するデータセットによる再調整も含めて、配備・実運用するために必要なトータルサポートを提供致します。

[詳細] (01/11/2019)

PyTorch & TensorFlow : ClassCat® TF / ONNX Hub : 医療画像処理モデル

「ClassCat® TF / ONNX Hub」はクラスキャットが提供する実用性の高い機械学習モデルのレポジトリです。各モデルは TensorFlow 固有フォーマットと ONNX フォーマットの両者で提供されます。

「ClassCat® TF / ONNX Hub」はクラスキャットが提供する実用性の高い機械学習モデルのレポジトリです。各モデルは TensorFlow 固有フォーマットと ONNX フォーマットの両者で提供されます。

今回は提供モデル群として医療画像処理モデルの代表例を紹介致します。胸部レントゲンや血液細胞画像を題材にしています。

「ClassCat TF / ONNX Hub」で提供されるモデルについてはクラスキャットが検証の上で仕様を公開致しますので、ユーザ企業は希望するモデルを自由に選択することが可能です。またユーザ企業の保持するデータセットによる再調整も含めて、配備・実運用するために必要なトータルサポートを提供致します。

[詳細] (01/10/2019)

PyTorch & TensorFlow : ClassCat® TF / ONNX Hub : GAN モデル

「ClassCat® TF / ONNX Hub」はクラスキャットが提供する実用性の高い機械学習モデルのレポジトリです。各モデルは TensorFlow 固有フォーマットと ONNX フォーマットの両者で提供されます。

「ClassCat® TF / ONNX Hub」はクラスキャットが提供する実用性の高い機械学習モデルのレポジトリです。各モデルは TensorFlow 固有フォーマットと ONNX フォーマットの両者で提供されます。

提供モデル群第一弾として GAN モデルの代表例を紹介致します。

「ClassCat TF / ONNX Hub」で提供されるモデルについてはクラスキャットが検証の上で仕様を公開致しますので、ユーザ企業は希望するモデルを自由に選択することが可能です。またユーザ企業の保持するデータセットによる再調整も含めて、配備・実運用するために必要なトータルサポートを提供致します。

[詳細] (01/05/2019)

クラスキャット、「ClassCat® Auto GAN」 及び「ClassCat® ONNX Hub」を提供開始

及び機械学習モデル・レポジトリ「ClassCat® ONNX Hub」の提供を開始

– 「ClassCat® ONNX Hub」第一弾として GAN モデル群の提供を開始 –

クラスキャット AI リサーチ (株式会社クラスキャット、代表取締役社長:佐々木規行、茨城県取手市)は、深層学習 GAN モデルを手軽に構築可能なツールキット「ClassCat® Auto GAN」及び機械学習モデル・レポジトリ「ClassCat® ONNX Hub」の提供を1月7日から開始することを発表致しました。「ClassCat® ONNX Hub」の提供モデル第一弾として GAN モデル群の提供も併せて実施致します。

[Read More …] (01/04/2019)

◆ 〜 2018/12/21

PyTorch 1.0 Tutorials : PyTorch 拡張 : numpy と scipy を使用した拡張の作成

PyTorch 1.0 は JIT コンパイラ・C++ フロントエンドの導入によるプロダクション・サポート機能が追加され、新規分散パッケージにより大規模なスケールでモデルを高速に効率的に実行することが可能になります。

クラスキャットは PyTorch 1.0 の無償サポートを開始しその一環としてドキュメントの日本語翻訳を提供しています。

今回は PyTorch の拡張のための短いチュートリアルで、新しいニューラルネットワーク層を NumPy と SciPy を利用して簡単に作成してみます。学習可能なパラメータを持たない場合と持つ場合に対応しています。

[詳細] (12/13/2018)

PyTorch 1.0 Tutorials : 生成モデル : DCGAN

PyTorch は NLP や確率的プログラミングで特に利用されている深層学習フレームワークです。PyTorch 1.0 ではプロダクション・サポート機能が追加されて大規模スケールでモデルを実行することが可能になりました。

PyTorch は NLP や確率的プログラミングで特に利用されている深層学習フレームワークです。PyTorch 1.0 ではプロダクション・サポート機能が追加されて大規模スケールでモデルを実行することが可能になりました。

クラスキャットは PyTorch 1.0 の無償サポートを開始しその一環としてドキュメントの日本語翻訳を提供しています。

今回は DCGAN へのイントロダクションです。多くの現実のセレブの写真を題材にして新しいセレブを生成するために GAN (敵対的生成ネットワーク) を訓練します。

[詳細] (12/21/2018)

PyTorch 1.0 Tutorials : 画像: ONNX を使用して PyTorch から Caffe2 とモバイルにモデルを移す

PyTorch 1.0 は JIT コンパイラ・C++ フロントエンドの導入によるプロダクション・サポート機能が追加され、新規分散パッケージにより大規模なスケールでモデルを高速に効率的に実行することが可能になります。

PyTorch 1.0 は JIT コンパイラ・C++ フロントエンドの導入によるプロダクション・サポート機能が追加され、新規分散パッケージにより大規模なスケールでモデルを高速に効率的に実行することが可能になります。

クラスキャットは PyTorch 1.0 の無償サポートを開始しています。その一環としてドキュメントの日本語翻訳を提供していきます。

今回は ONNX を使用して PyTorch から Caffe2、更にモバイル環境にモデルを移行するチュートリアルです。このチュートリアルでは、超解像ネットワーク (Super-Resolution) を題材にして、PyTorch で定義された超解像モデルをどのように ONNX フォーマットに変換するか、そしてそれをどのように Caffe2 にロードするかについて説明します。更にモバイルデバイス (Android) へのロード・実行方法も解説します。

[詳細] (12/14/2018)

PyTorch 1.0 Tutorials : テキスト : Sequence to Sequence ネットワークと Attention で翻訳

PyTorch は NLP や確率的プログラミングで特に利用されている深層学習フレームワークです。PyTorch 1.0 ではプロダクション・サポート機能が追加されて大規模なスケールでモデルを実行することが可能になりました。

PyTorch は NLP や確率的プログラミングで特に利用されている深層学習フレームワークです。PyTorch 1.0 ではプロダクション・サポート機能が追加されて大規模なスケールでモデルを実行することが可能になりました。

クラスキャットは PyTorch 1.0 の無償サポートを開始しその一環としてドキュメントの日本語翻訳を提供しています。

今回は「フランス語 to 英語」の翻訳をニューラルネットワークに学習させることに挑戦してみます。基本モデルは Sequence to Sequence モデルで、これはエンコーダとデコーダの 2 つの RNN から成るモデルです。

モデルを改良するためにデコーダにアテンション・メカニズムを組み込み、そしてアテンションの重みの可視化も行ないます。訓練時には “Teacher forcing” の手法も確率的に用います。

[詳細] (12/13/2018)

PyTorch 1.0 Tutorials : テキスト : 文字レベル RNN で名前を分類する

PyTorch は NLP や確率的プログラミングで特に利用されている深層学習フレームワークです。PyTorch 1.0 ではプロダクション・サポート機能が追加され、大規模なスケールでモデルを高速に効率的に実行することが可能になります。

PyTorch は NLP や確率的プログラミングで特に利用されている深層学習フレームワークです。PyTorch 1.0 ではプロダクション・サポート機能が追加され、大規模なスケールでモデルを高速に効率的に実行することが可能になります。

クラスキャットは PyTorch 1.0 の無償サポートを開始しその一環としてドキュメントの日本語翻訳を提供しています。

今回は自然言語処理がテーマのチュートリアルで、文字レベル RNN による名前分類です。題材は 18 言語から成る数千の姓名データベースで、名前を分類するために基本的な文字レベル RNN を構築して訓練します。予測の評価は混同行列で図示します。

[詳細] (12/12/2018)

PyTorch 1.0 Tutorials : テキスト : 文字レベル RNN で名前を生成する

PyTorch は NLP や確率的プログラミングで特に利用されている深層学習フレームワークです。PyTorch 1.0 ではプロダクション・サポート機能が追加され、大規模なスケールでモデルを高速に効率的に実行することが可能になります。

PyTorch は NLP や確率的プログラミングで特に利用されている深層学習フレームワークです。PyTorch 1.0 ではプロダクション・サポート機能が追加され、大規模なスケールでモデルを高速に効率的に実行することが可能になります。

クラスキャットは PyTorch 1.0 の無償サポートを開始しその一環としてドキュメントの日本語翻訳を提供しています。

今回は自然言語処理がテーマのチュートリアルで、題材として 18 言語から成る数千の姓名データベースを使用します。文字レベル RNN で名前「生成」を遂行する、いわゆる言語モデルでネットワークモデルからサンプリングすることになります。

[詳細] (12/11/2018)

PyTorch 1.0 Tutorials : テキスト : NLP 深層学習 (4) シーケンスモデルと LSTM ネットワーク

今回は「NLP のための深層学習 (4)」として品詞タギングを題材にシーケンスモデルと LSTM ネットワークを扱います。

シーケンスモデルは NLP の中核を成しますが、本チュートリアルでは Pytorch の LSTM の基本仕様を説明した後、品詞タギングのための簡単なサンプルを LSTM を利用して実装してみます。

クラスキャットは PyTorch 1.0 の無償サポートを開始しその一環としてドキュメントの日本語翻訳を提供しています。

[詳細] (12/12/2018)

PyTorch 1.0 Tutorials : テキスト : NLP 深層学習 (3) 単語埋め込み : 語彙意味論的エンコード

今回は「NLP のための深層学習 (3)」として PyTorch による自然言語処理の本格的な説明と実装に入り、単語埋め込みを通して語彙意味論的なエンコードを行ないます。前半は分布仮説と単語埋め込みの基礎概念が詳細に説明されます。後半は、PyTorch による基本的な単語埋め込みの実装を行ない、そして代表的な言語モデル N-Gram、更には CBOW を実装します。

クラスキャットは PyTorch 1.0 の無償サポートを開始しその一環としてドキュメントの日本語翻訳を提供しています。

[詳細] (12/12/2018)

PyTorch 1.0 Tutorials : テキスト : NLP 深層学習 (2) PyTorch で深層学習

今回は「NLP のための深層学習 (2)」として簡単な Bag-of-Words 分類器を扱います。PyTorch によるネットワーク構成のサンプルとして英語とスペイン語のセンテンスの分類を遂行する簡単な Bag-of-Words 分類器を作成してみます。

クラスキャットは PyTorch 1.0 の無償サポートを開始しています。その一環としてドキュメントの日本語翻訳を提供しています。

[詳細] (12/11/2018)

PyTorch 1.0 Tutorials : テキスト : NLP 深層学習 (1) PyTorch へのイントロダクション

今回から「自然言語処理 (NLP) のための深層学習」編に入ります。最初のチュートリアルでは (NLP には触れずに) PyTorch のポイントを抑えるために、Tensor の基礎概念 – 作成・演算から解説されています。次いで自動微分の概念、特に requires_grad フラグの利用方法について具体例をあげて分かりやすく説明されています。

クラスキャットは PyTorch 1.0 の無償サポートを開始しその一環としてドキュメントの日本語翻訳を提供しています。

[詳細] (12/11/2018)

クラスキャット、PyTorch 1.0 対応人工知能モデルと各種サポートの提供を開始

PyTorch 1.0 対応人工知能モデルと各種サポートの提供を開始

– モデルの訓練・配備・実運用までをマルチクラウドでトータルサポート –

[Read More …] (12/10/2018)

PyTorch 1.0 : Getting Started : データ並列

PyTorch 1.0 は JIT コンパイラ・C++ フロントエンドの導入によるプロダクション・サポート機能が追加され、新規分散パッケージにより大規模なスケールでモデルを高速に効率的に実行することが可能になります。

今回は PyTorch のデータ並列のチュートリアルの翻訳です。DataParallel を使用して複数の GPU をどのように使用するかを説明します。

クラスキャットは PyTorch 1.0 の無償サポートを開始しています。その一環としてドキュメントの日本語翻訳を提供していきます。

[詳細] (12/09/2018)

PyTorch 1.0 リリースノート

◆ PyTorch 1.0 ステーブル版リリース (12/07)

◆ クラスキャット、PyTorch 1.0 の無償サポート

待望の PyTorch 1.0 ステーブル版が 12/07 にリリースされましたので、リリースノートの新規機能をまとめたパートを翻訳しておきました。JIT・(新規の) 分散パッケージ・C++ フロントエンド・Torch Hub がその中心機能で、プロダクション・サポートを強く意識したリリースになっています。大規模なスケールでモデルを高速に効率的に実行することが可能になります。

PyTorch は主として自然言語処理や確率的プログラミングの領域で数多く利用され始めています。各種エコシステムでは PyTorch 1.0 への移行も進んでいます。

クラスキャットでは PyTorch 1.0 の無償サポートを開始しております。具体的には各種ドキュメントの日本語翻訳、FAQ の提供、有用なコードスニペットの提供等を実施していきます。

[詳細] (12/08/2018)

PyTorch 1.0 : Getting Started : 分類器を訓練する – CIFAR-10

最新の深層学習フレームワーク PyTorch 1.0 安定版が 12/07 に公開されました。PyTorch 1.0 は JIT コンパイラ・C++ フロントエンドの導入によるプロダクション・サポート機能が追加され、新規分散パッケージにより大規模なスケールでモデルを高速に効率的に実行することが可能になります。

最新の深層学習フレームワーク PyTorch 1.0 安定版が 12/07 に公開されました。PyTorch 1.0 は JIT コンパイラ・C++ フロントエンドの導入によるプロダクション・サポート機能が追加され、新規分散パッケージにより大規模なスケールでモデルを高速に効率的に実行することが可能になります。

クラスキャットは PyTorch 1.0 の無償サポートを開始しています。その一環としてドキュメントの日本語翻訳を提供していきます。

今回はシングル GPU 上で CIFAR-10 の分類器訓練を扱います。具体的には次のステップを実行します : (1) CIFAR10 訓練/テスト・データセットをロードして正規化、(2) 畳込みニューラルネットワークを定義、(3 ) 損失関数を定義、(4) 訓練データ上でネットワークを訓練、そして (5) テストデータでネットワークを評価します。

PyTorch 1.0 のステーブル版が公開されましたが、既に各種エコシステムでは PyTorch 1.0 への移行が進んでいます。

[詳細] (12/08/2018)

PyTorch 1.0 : Getting Started : ニューラルネットワーク

最新の深層学習フレームワーク PyTorch 1.0 安定版が 12/07 に公開されました。PyTorch 1.0 は JIT コンパイラ・C++ フロントエンドの導入によるプロダクション・サポート機能が追加され、新規分散パッケージにより大規模なスケールでモデルを高速に効率的に実行することが可能になります。

クラスキャットは PyTorch 1.0 の無償サポートを開始致しました。その一環としてドキュメントの日本語翻訳を提供していきます。今回は標準的な LeNet を題材にした PyTorch ニューラルネットのチュートリアルです。PyTorch におけるニューラルネットの定義・損失関数・逆伝播・重みの更新について説明されます。

PyTorch 1.0 のステーブル版が公開されましたが、既に各種エコシステムでは PyTorch 1.0 への移行が進んでいます。

[詳細] (12/07/2018)

PyTorch 1.0 : Getting Started : Autograd: 自動微分

PyTorch は急伸している深層学習フレームワークで、自然言語処理や確率的プログラミングの領域で数多く利用されています。PyTorch 1.0 では JIT コンパイラの導入をはじめとするプロダクション・サポートのための機能が追加され、大規模なスケールでモデルを効率的に実行することが可能になります。

クラスキャットは PyTorch 1.0 の無償サポートを開始しています。その一環としてドキュメントの日本語翻訳を提供していきます。今回は PyTorch で総てのニューラルネットワークの中核をなす autograd パッケージを扱います。autograd は tensor 上の総ての演算に対して自動微分を提供します。

現在 PyTorch 1.0 デベロッパー・プレビュー版が公開されていますが、既に各種エコシステムでは PyTorch 1.0 への移行が進んでいます。

[詳細] (12/07/2018)

PyTorch 1.0 : Getting Started : PyTorch とは何か?

PyTorch は急伸している深層学習フレームワークで、自然言語処理や確率的プログラミングの領域で数多く利用されています。PyTorch 1.0 では JIT コンパイラの導入をはじめとするプロダクション・サポートのための機能が追加され、大規模なスケールでモデルを効率的に実行することが可能になります。

クラスキャットは PyTorch 1.0 の無償サポートを開始しています。その一環としてドキュメントの日本語翻訳を提供していきます。今回は PyTorch の基本である テンソル、演算、Numpy ブリッジ、CUDA テンソルについての簡単な説明が提供されます。

現在 PyTorch 1.0 デベロッパー・プレビュー版が公開されていますが、既に各種エコシステムでは PyTorch 1.0 への移行が進んでいます。

[詳細] (12/07/2018)

PyTorch 1.0 へのロード : プロダクション・レディ PyTorch

◆ クラスキャット、PyTorch 1.0 の無償サポートを開始

深層学習フーレムワークのデファクトスタンダードは現状 TensorFlow と考えられますが、PyTorch も主として自然言語処理や確率的プログラミングの領域で数多く利用され始めています。

そして期待される PyTorch 1.0 では JIT コンパイラの導入をはじめとするプロダクション・サポートのための機能が追加されます。大規模なスケールでモデルを効率的に実行することが可能になります。

現在 PyTorch 1.0 デベロッパー・プレビュー版が公開されていますが、既に各種エコシステムでは PyTorch 1.0 への移行が進んでいることを考慮し、クラスキャットでは先行して本日 (12/07) より PyTorch 1.0 の無償サポートを開始致します。具体的には各種ドキュメントの日本語翻訳、FAQ の提供、有用なコードスニペットの提供等を実施していきます。

- PyTorch 1.0 へのロード : プロダクション・レディ PyTorch

- Caffe2 と PyTorch が協力して「研究 + プロダクション」プラットフォーム PyTorch 1.0 を作成

◆ 〜 2018/05/28 (v0.4)

PyTorch : PyTorch デザインノート : Multiprocessing ベストプラクティス

PyTorch のデザインノートの翻訳をしています。最新の PyTorch 0.4.0 リリースにも対応しています。

今回はマルチプロセス処理を扱います。

Python の multiprocessing モジュール互換な torch.multiprocessing パッケージがテーマで、ベストプラクティスとしてデッドロックの回避、multiprocessing.Queue、更には非同期マルチプロセス i.e. モデルの非同期な訓練について説明されます。その例として Hogwild アルゴリズムも扱われます。

[詳細] (05/28/2018)

PyTorch : PyTorch デザインノート : Frequently Asked Questions

PyTorch のデザインノートの翻訳をしています。最新の PyTorch 0.4.0 リリースにも対応しています。

今回はプログラミング視点の FAQ です。

GPU メモリが不足するパターンとその対応方法を中心に、GPU メモリの適切な解放、データ並列でリカレント・ニューラルネットワークを扱う際の注意点等が説明されます。

[詳細] (05/27/2018)

PyTorch : PyTorch デザインノート : PyTorch を拡張する

PyTorch のデザインノートの翻訳をしています。最新の PyTorch 0.4.0 リリースにも対応しています。

今回は PyTorch の拡張を扱います。

このノートでは torch.autograd と torch.nn を拡張する方法、及び Module を追加する方法をカバーします :

- autograd への演算の追加は新しい Function サブクラスの実装を必要とします。

- torch.nn の拡張に関しては、nn は 2 種類のインターフェイス: モジュールとその functional バージョンを持ちますが、層のためにはモジュールを使用し、(活性化関数のような) パラメータ-less 演算のためには functional 形式の使用が推奨されます。

[詳細] (05/26/2018)

PyTorch : PyTorch デザインノート : CUDA セマンティクス

PyTorch のデザインノートの翻訳をしています。最新の PyTorch 0.4.0 リリースにも対応しています。

今回は CUDA 演算を扱います。

デフォルトでは GPU 演算は非同期ですが、同期の強制や CUDA ストリームにおける注意点を説明します。またメモリ管理の説明の後、ベストプラクティスとしてデバイス不可知なコードの書き方やマルチプロセス処理についても詳述されます。

[詳細] (05/25/2018)

PyTorch : PyTorch デザインノート : ブロードキャスト・セマンティクス

PyTorch の上級チュートリアルの翻訳を完了し、デザインノートの翻訳をしています。

最新の PyTorch 0.4.0 リリースにも対応しています。今回はブロードキャストのトピックを扱います。

多くの PyTorch 演算は NumPy ライクなブロードキャストをサポートします。

ブロードキャスト可能なケースの仕様を示した上で後方互換性の問題について議論します。

[詳細] (05/23/2018)

PyTorch : PyTorch デザインノート : Autograd メカニクス

PyTorch の上級チュートリアルの翻訳を完了し、デザインノートの翻訳に移ります。

最新の PyTorch 0.4.0 リリースにも対応しています。最初は Autograd のデザインノートです。

このノートは autograd がどのように動作して演算を記録するかの概要を示します。必ずしもこの総てを厳密に理解する必要はありませんが、デバッグやより効率的できれいなプログラムを書くために役立ちますので、それに精通することが推奨されます。

[詳細] (05/22/2018)

PyTorch : Tutorial 上級 : カスタム C++ と CUDA エクステンション

PyTorch の上級チュートリアルを翻訳しています。最新の PyTorch 0.4.0 リリースにも対応しています。

今回は LSTM の変種を題材に C++/CUDA エクステンションの作成方法が詳細に示されます。

カスタム演算を PyTorch で統合する最も簡単な方法は関数とモジュールを拡張して Python で書くことですが、貴方の演算が C++ で実装される方が良い場合もあります。例えば演算が高速であることが望まれるかもしれませんし、他の C や C++ ライブラリに依拠する場合もあるでしょう。

そのようなケースに対処するために、PyTorch はカスタム C++ 拡張を書く簡単な方法 – C++ エクステンションを提供しています。このチュートリアルでは LSTM の変種をカスタム・セル – 実際的なサンプルとして、C++ (そして CUDA) エクステンションを書いて利用する手法が詳細に解説されます。

具体的には、C++ エクステンションをどのように実装して利用できるかを見ていきます。PyTorch のバックエンドを駆動している ATen ライブラリを利用して C++ で書くことから始めて、次いで GPU が提供する大規模な並列処理からメリットを享受するためにモデルのパーツを CUDA カーネルに移して更に高速化を図ります。

[詳細] (05/22/2018)

PyTorch : Tutorial 中級 : Spatial Transformer ネットワーク

PyTorch の中級チュートリアルを翻訳しています。最新の PyTorch 0.4.0 リリースにも対応しています。

PyTorch の中級チュートリアルを翻訳しています。最新の PyTorch 0.4.0 リリースにも対応しています。

今回は Spatial Transformer ネットワークを扱います。この視覚アテンション・メカニズムを使用して貴方のネットワークを増強することができます。実際に、MNIST データセットを題材にして Spatial Transformer ネットワークで増強した標準的な畳み込みネットワークで実験してみます。

Spatial Transformer ネットワークは、簡単に言えば、ニューラルネットがモデルの幾何学的不変性を高めるために入力画像上でどのように空間変換を遂行するかを学習することを可能にします。例えばそれは関心領域をクロップし、スケールし、そして画像の方向性を正すことができます。

これは有用なメカニズムになりえます、何故ならば CNN は回転とスケールと更に一般的なアフィン変換に対して不変ではないからです。Spatial Transformer ネットワークについて最良なことの一つはそれを非常に少ない変更で任意の既存の CNN に単純にプラグインするアビリティです。

[詳細] (05/17/2018)

PyTorch : Tutorial 中級 : PyTorch で分散アプリケーションを書く

PyTorch の中級チュートリアルを翻訳しています。最新の PyTorch 0.4.0 リリースにも対応しています。今回は分散アプリケーションの作成に必要な PyTorch の分散パッケージを見ていきます。

PyTorch の中級チュートリアルを翻訳しています。最新の PyTorch 0.4.0 リリースにも対応しています。今回は分散アプリケーションの作成に必要な PyTorch の分散パッケージを見ていきます。

分散環境のセットアップからはじめて、異なる通信ストラテジー : ポイント・ツー・ポイント通信と集合的通信をどのように利用するかについてサンプル・スクリプトで説明されます。

更に、通信バックエンドと初期化メソッドについて詳述されます。通信バックエンドとしては TCP, MPI そして Gloo が利用できます。パッケージ内部の流れについても説明されます。

[詳細] (05/16/2018)

PyTorch : Tutorial 初級 : Torch ユーザのための PyTorch – nn パッケージ

PyTorch の初級チュートリアルを翻訳しています。最新の PyTorch 0.4.0 リリースにも対応しています。

PyTorch の初級チュートリアルを翻訳しています。最新の PyTorch 0.4.0 リリースにも対応しています。

今回は Lua Torch ユーザのために PyTorch nn パッケージを解説します (Lua Torch の経験がなくても問題なく読み進めることができます)。

最初にアーキテクチャ上の違い、特に状態の保持方法の違いについて簡単に説明されます。

次に、ConvNet と RNN モデルの実装例を見てみます。forward/backward 上の hook の利用方法についても説明されます。

[詳細] (05/11/2018)

※ その他、記載されている会社名・製品名は各社の登録商標または商標です。